Unidad 4 - Análisis exploratorio de datos: Visualizaciones#

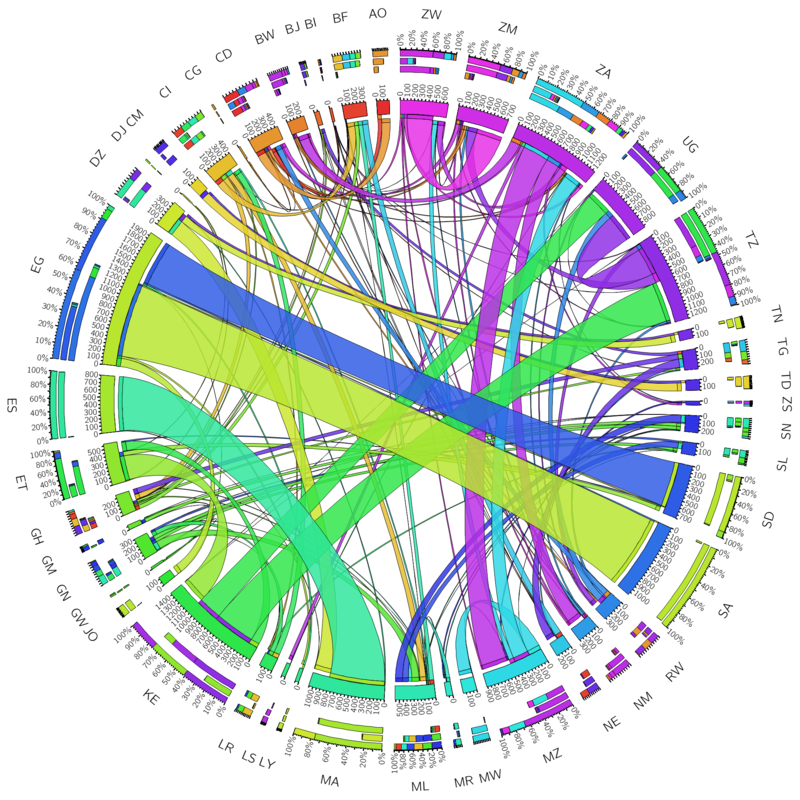

Introducción: ver para entender#

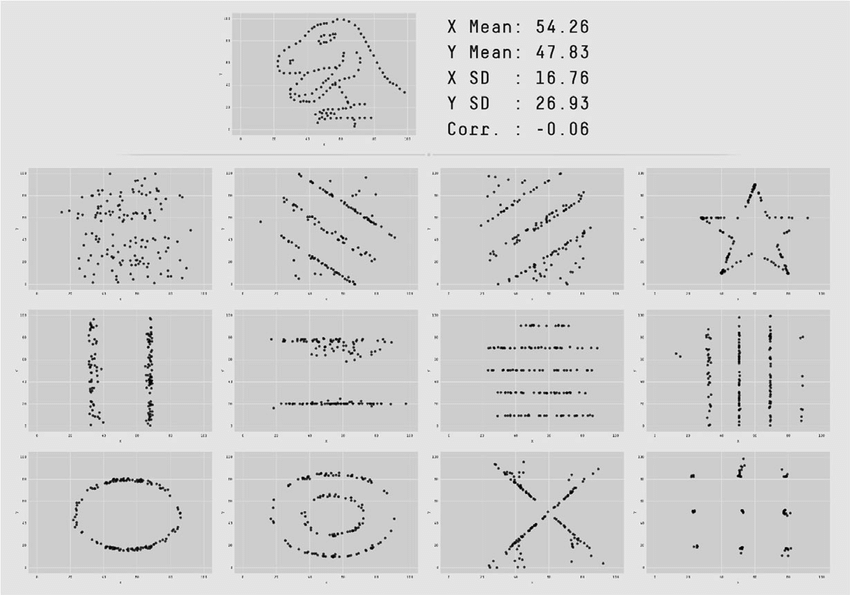

En la unidad anterior construimos una idea central: en ciencia de datos, trabajar únicamente con medidas descriptivas no es suficiente. Podemos calcular medias, cuartiles, desvíos estándar, rangos o coeficientes de correlación y, aun así, pasar por alto aspectos fundamentales del comportamiento de los datos.

Un ejemplo clásico que ilustra esto es el Datasaurus Dozen: un conjunto de datasets que comparten prácticamente las mismas estadísticas descriptivas pero que, al visualizarse, revelan patrones completamente distintos.

Fig. 13 El Datasaurus Dozen.#

Este ejemplo deja una enseñanza clave:

Dos conjuntos de datos pueden ser “idénticos” en términos de sus medidas descriptivas y, sin embargo, ser completamente diferentes en su estructura.

Por eso, en análisis de datos, visualizar no es opcional: es una herramienta fundamental para comprender lo que las estadísticas, por sí solas, no pueden mostrar.

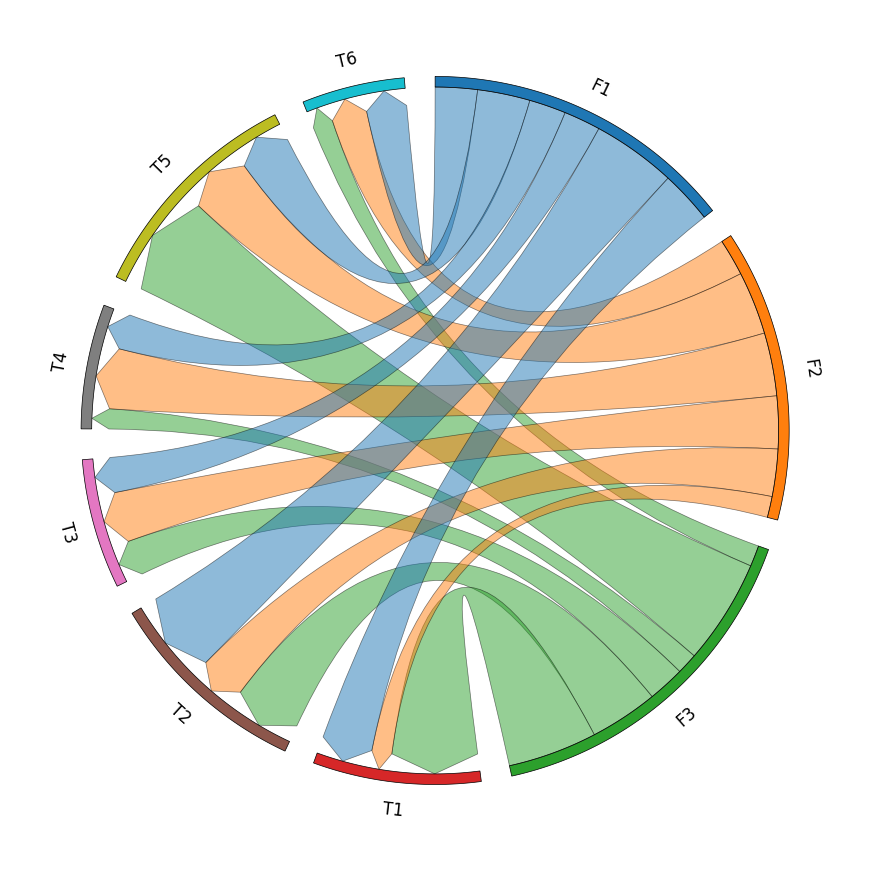

¿Qué es la visualización de datos?#

La visualización de datos es mucho más que construir gráficos. Es una forma de representar información visualmente con el objetivo de generar conocimiento.

A través de gráficos, diagramas o mapas podemos detectar patrones, identificar tendencias, reconocer valores atípicos y descubrir relaciones entre variables. Además, la visualización cumple un rol central en la comunicación de resultados: un buen gráfico puede transmitir en segundos lo que requeriría páginas de texto o extensas tablas numéricas.

Visualizar para entender y para comunicar#

Una idea central en visualización de datos es que no todos los gráficos cumplen el mismo propósito. En términos generales, podemos distinguir dos grandes usos: la exploración y la explicación.

En la visualización exploratoria, el objetivo es entender los datos. Los gráficos se utilizan como herramienta de investigación para detectar patrones, anomalías o relaciones que no eran evidentes a priori. En esta etapa muchas veces no existe una hipótesis clara, y el proceso está guiado por la curiosidad y la observación.

Este enfoque ha sido estudiado en el trabajo de Yanai y Lercher (2020), quienes muestran que tener hipótesis previas puede, paradójicamente, dificultar el descubrimiento. En su experimento, un grupo de estudiantes debía analizar un conjunto de datos con hipótesis específicas, mientras que otro debía explorarlo libremente. El dataset estaba diseñado de modo que, al graficarlo, revelaba con claridad la figura de un gorila. Sin embargo, los estudiantes enfocados en las hipótesis fueron mucho menos propensos a detectarlo.

Este resultado ilustra un punto importante:

Cuando buscamos algo específico en los datos, podemos pasar por alto patrones evidentes.

En la visualización explicativa, el objetivo cambia: ya no se trata de descubrir, sino de comunicar un mensaje claro a una audiencia. En este caso, el gráfico se diseña cuidadosamente para resaltar una idea particular, priorizando la claridad y la efectividad del mensaje.

La distinción entre exploración y explicación es fundamental en ciencia de datos. En las primeras etapas del análisis conviene mantener una actitud abierta y dejar que los datos “hablen”. En etapas posteriores, la visualización se convierte en una herramienta de comunicación con un propósito bien definido.

En este sentido, la visualización no es una etapa aislada del proceso de análisis: aparece desde la exploración inicial hasta la comunicación final de resultados.

Herramientas de visualización en Python#

Python cuenta con múltiples librerías para generar visualizaciones. A continuación presentamos algunas de las más utilizadas.

Matplotlib#

Matplotlib es la biblioteca base de visualización en Python. Ofrece un control muy detallado sobre cada elemento del gráfico, lo que la hace extremadamente flexible. Su módulo más utilizado es pyplot, que permite construir gráficos de manera relativamente directa. Sin embargo, esa misma flexibilidad implica que, en muchos casos, se necesita más código para lograr visualizaciones complejas o con buen acabado estético.

Seaborn#

Seaborn es una librería construida sobre Matplotlib que simplifica la creación de gráficos. Su principal ventaja es que permite generar visualizaciones complejas con pocas líneas de código, incorporando además buenas prácticas de diseño por defecto.

Plotnine y la gramática de los gráficos#

Plotnine es una implementación en Python de la Grammar of Graphics, propuesta originalmente por Leland Wilkinson. Este enfoque concibe los gráficos como una combinación de componentes independientes:

datos

variables estéticas (ejes, color, tamaño, forma)

geometrías (puntos, barras, líneas)

transformaciones estadísticas

Esta forma de pensar resulta especialmente poderosa porque permite construir gráficos de manera sistemática y coherente, combinando componentes de forma modular.

Tipos de visualizaciones#

Existen muchas formas de clasificar los gráficos. En este curso seguiremos la propuesta de Claus Wilke en Fundamentals of Data Visualization, que organiza las visualizaciones según el tipo de información que buscan representar.

Nos enfocaremos en cinco grandes categorías.

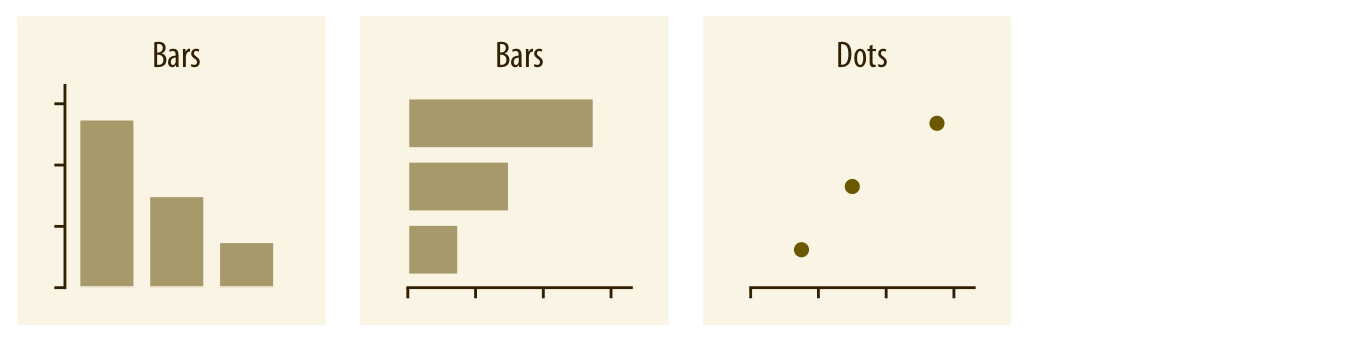

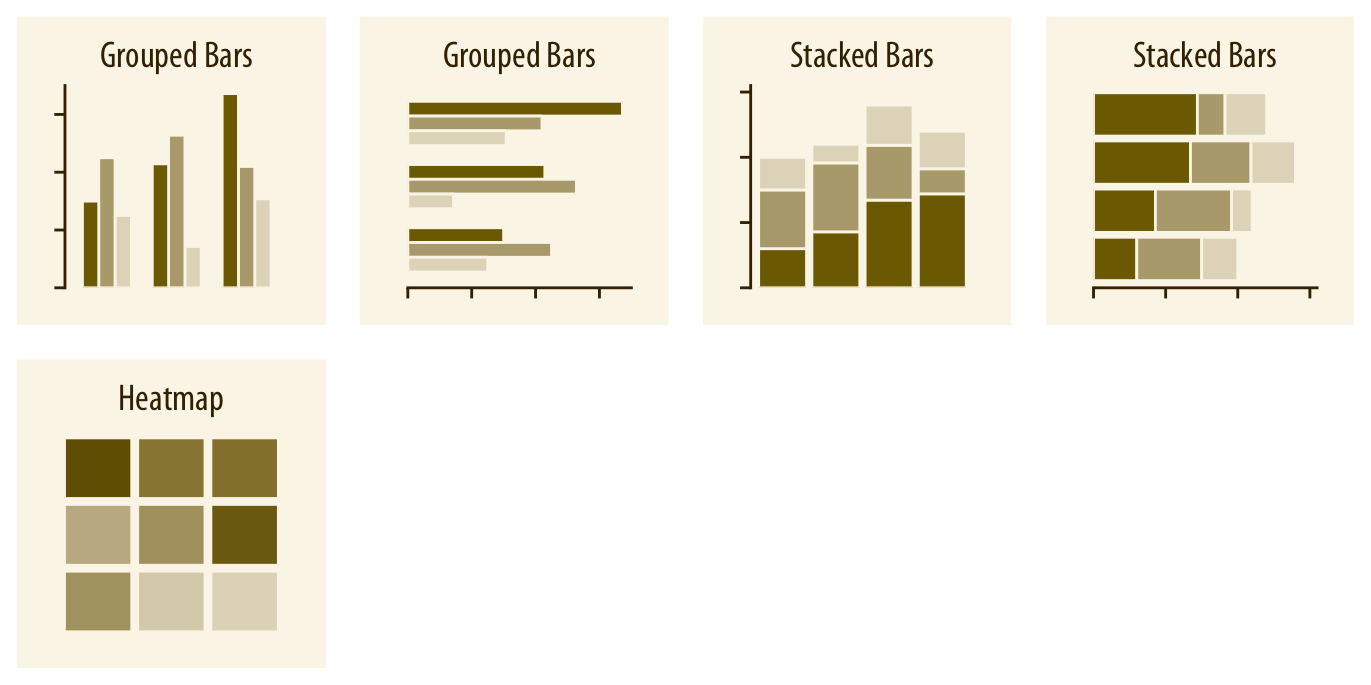

Cantidades#

Cuando queremos representar valores numéricos asociados a categorías, los gráficos más habituales son los de barras (verticales u horizontales) y los gráficos de puntos (dot plots). Estos permiten comparar magnitudes entre categorías de forma directa.

Cuando hay dos o más grupos de categorías, es posible agrupar o apilar las barras, o bien representar los valores mediante un mapa de calor (heatmap).

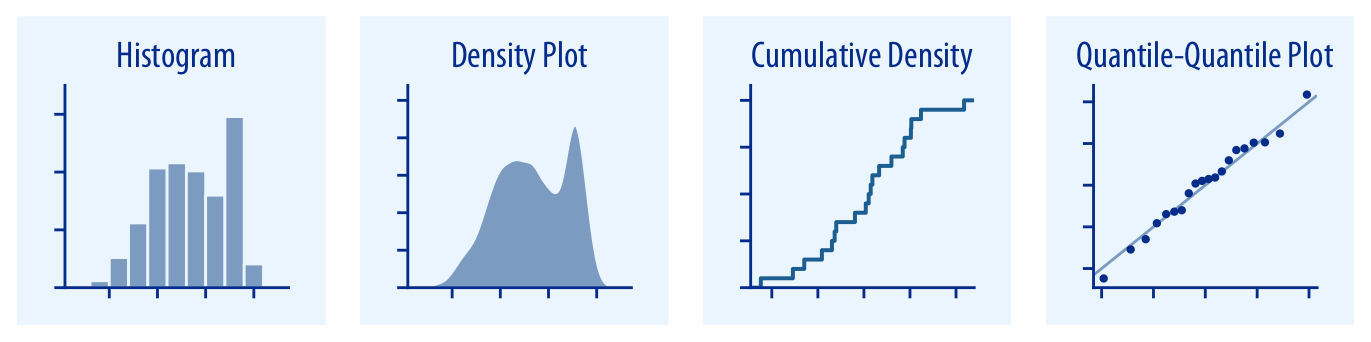

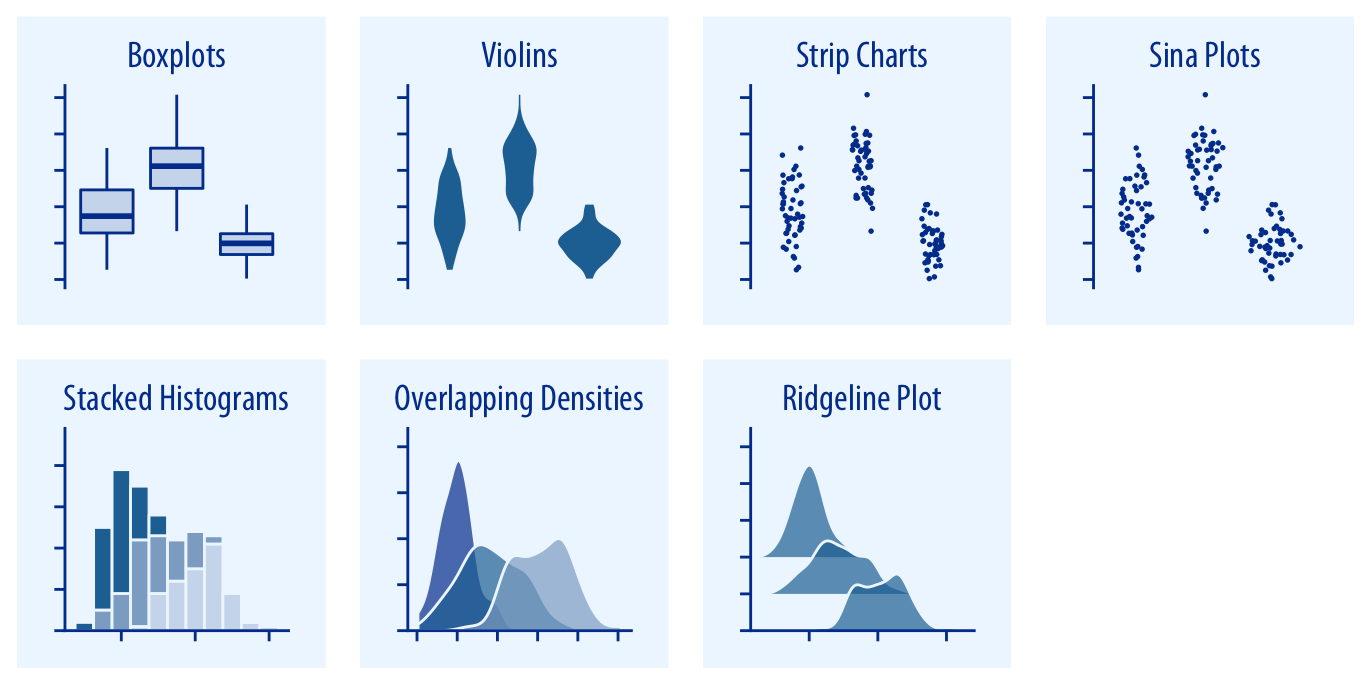

Distribuciones#

¿De qué hablamos cuando hablamos de distribución?

La distribución de una variable describe cómo se reparten sus valores: qué valores aparecen, con qué frecuencia y en qué rangos se concentran.

Para una única distribución, las herramientas más utilizadas son el histograma y el gráfico de densidad; también existen alternativas como las funciones de distribución acumulada empírica (ECDF) y los gráficos Q-Q, que representan los datos de forma más fiel aunque suelen ser más difíciles de interpretar. El boxplot, si bien es especialmente útil para comparar varias distribuciones, también puede emplearse para resumir una única distribución y detectar valores atípicos.

Cuando se quieren comparar varias distribuciones al mismo tiempo, herramientas como el boxplot, el gráfico de violín, el strip chart o el ridgeline plot permiten identificar diferencias en la forma, la dispersión y la presencia de valores atípicos.

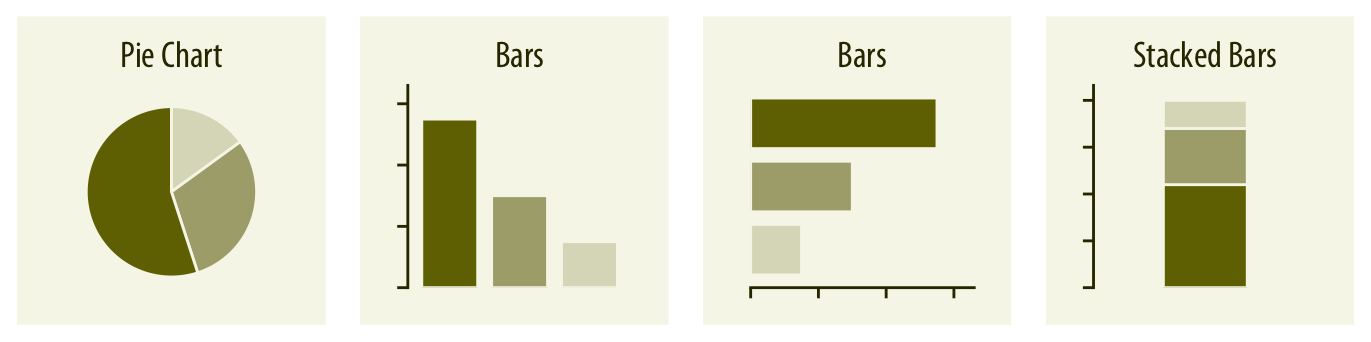

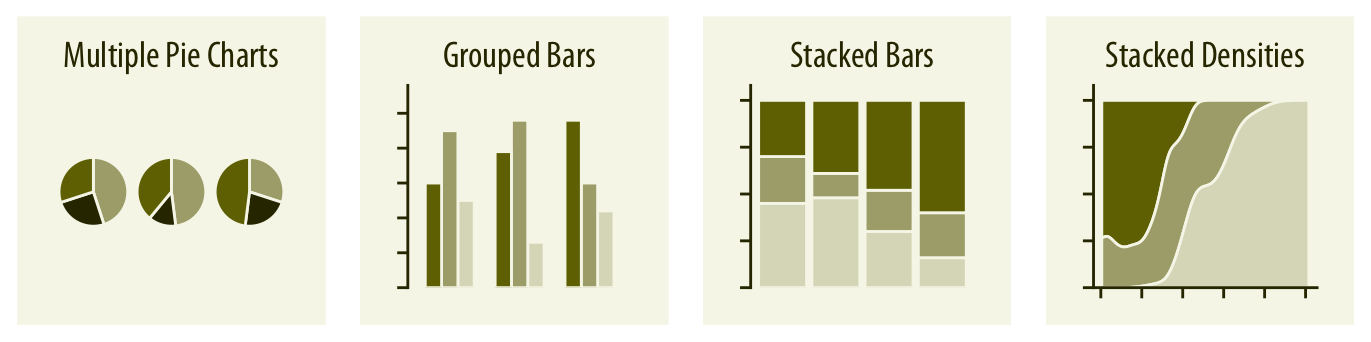

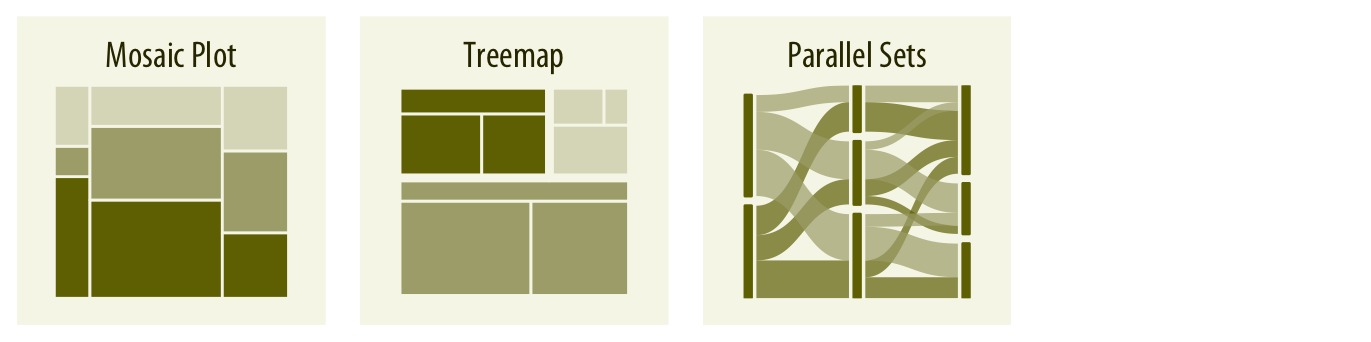

Proporciones#

Cuando el interés está en cómo se divide un todo entre distintas partes, los gráficos más utilizados son los de sectores (pie charts) y los de barras apiladas o agrupadas. Los gráficos de sectores son útiles para destacar fracciones simples y enfatizar que las partes suman un todo; las barras agrupadas, en cambio, facilitan la comparación directa entre categorías.

Cuando se comparan proporciones entre múltiples grupos o condiciones, los gráficos de sectores suelen volverse poco eficientes. En esos casos, las barras apiladas o agrupadas son preferibles. Para proporciones anidadas (es decir, cuando hay más de un nivel de agrupamiento), existen alternativas como los treemaps o los parallel sets.

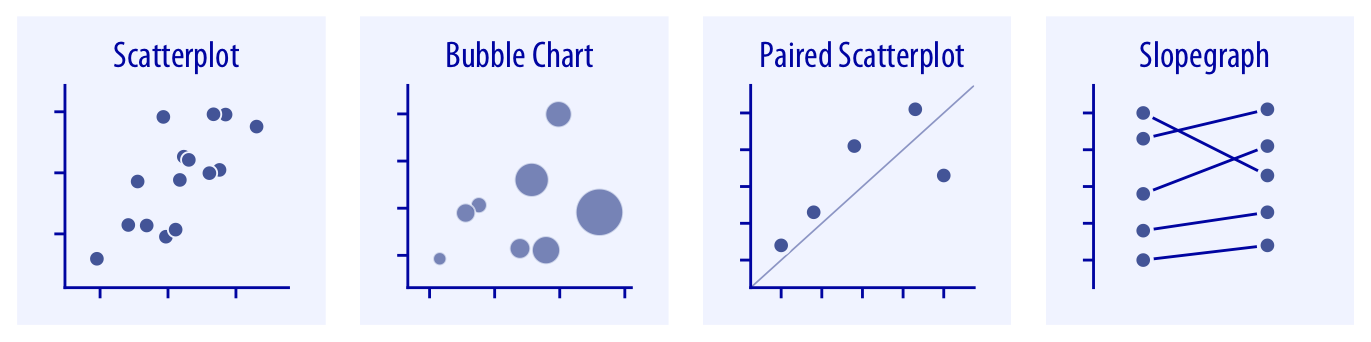

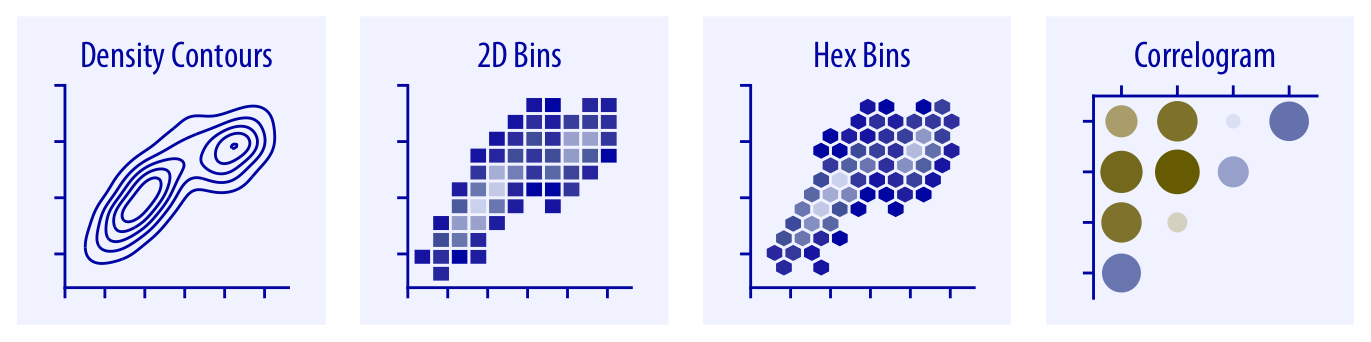

Relaciones entre variables cuantitativas#

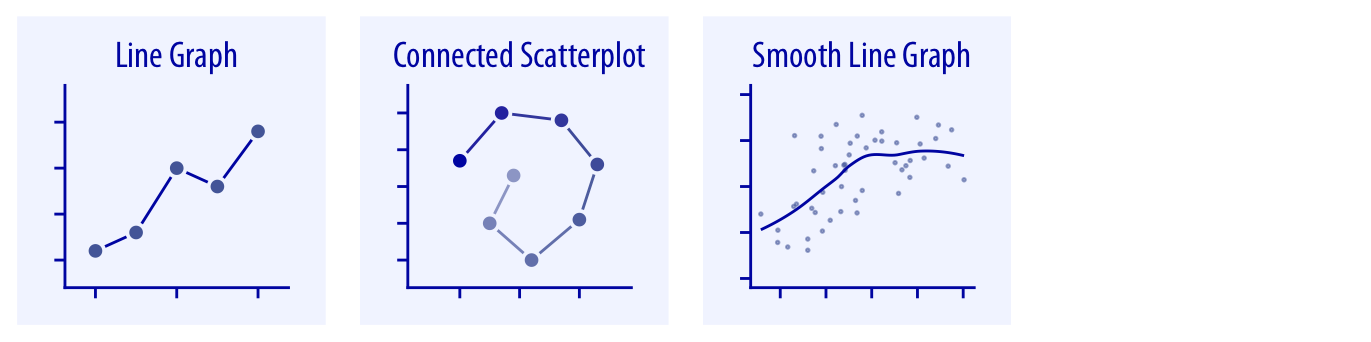

Para analizar la relación entre dos variables cuantitativas, el gráfico más fundamental es el scatterplot, que ya introdujimos en la unidad anterior. Permite detectar relaciones lineales o no lineales, patrones estructurales y posibles valores atípicos.

Cuando el eje x representa el tiempo, se suelen usar gráficos de línea. Cuando hay muchos puntos y el scatterplot se vuelve difícil de leer por superposición, alternativas como los gráficos de contorno, los histogramas 2D o los hex bins resultan más informativos.

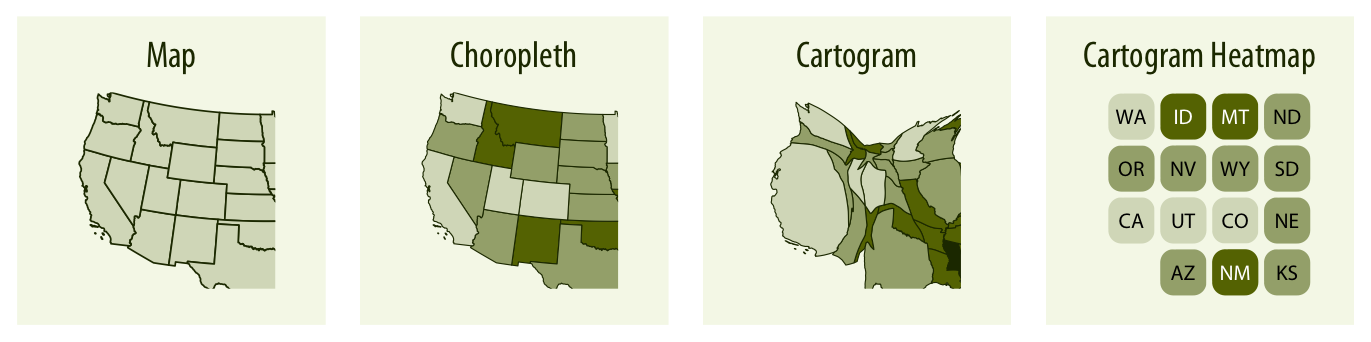

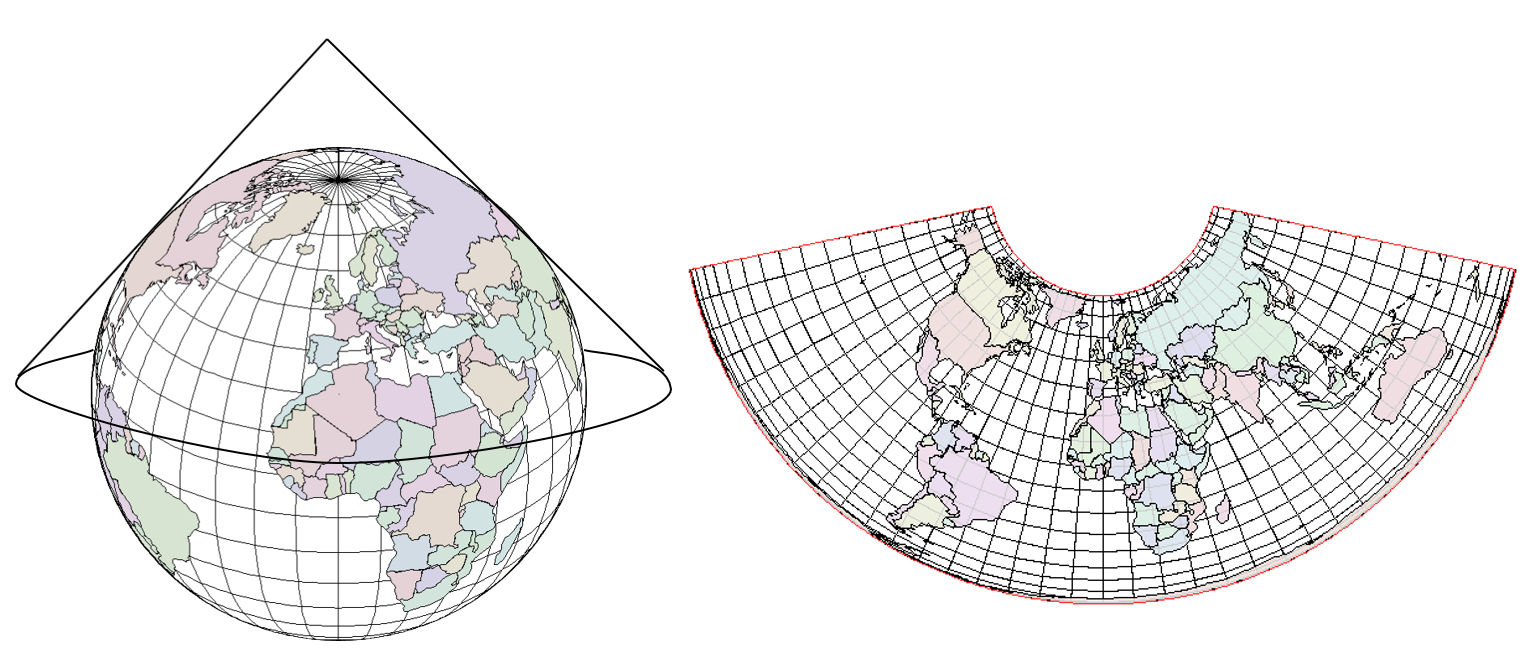

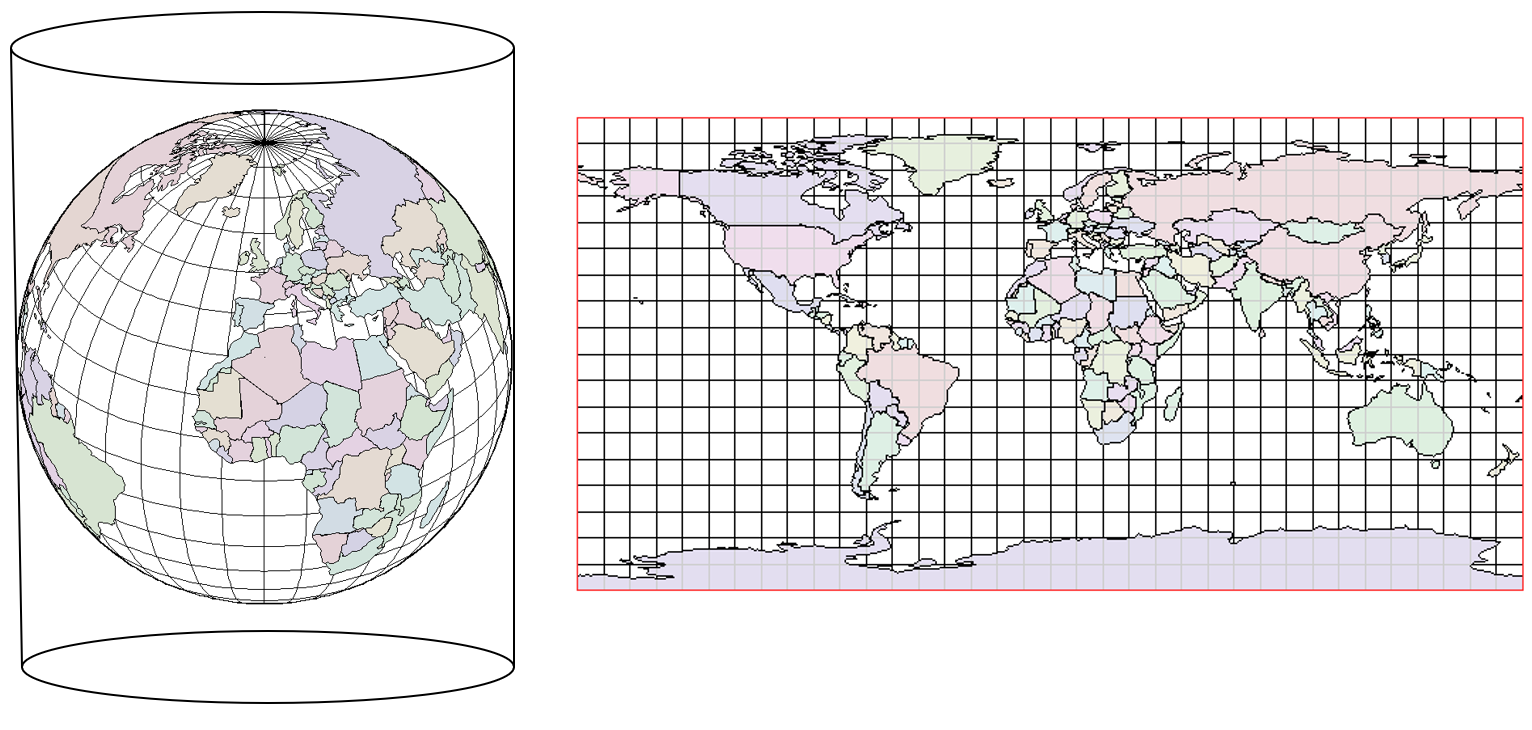

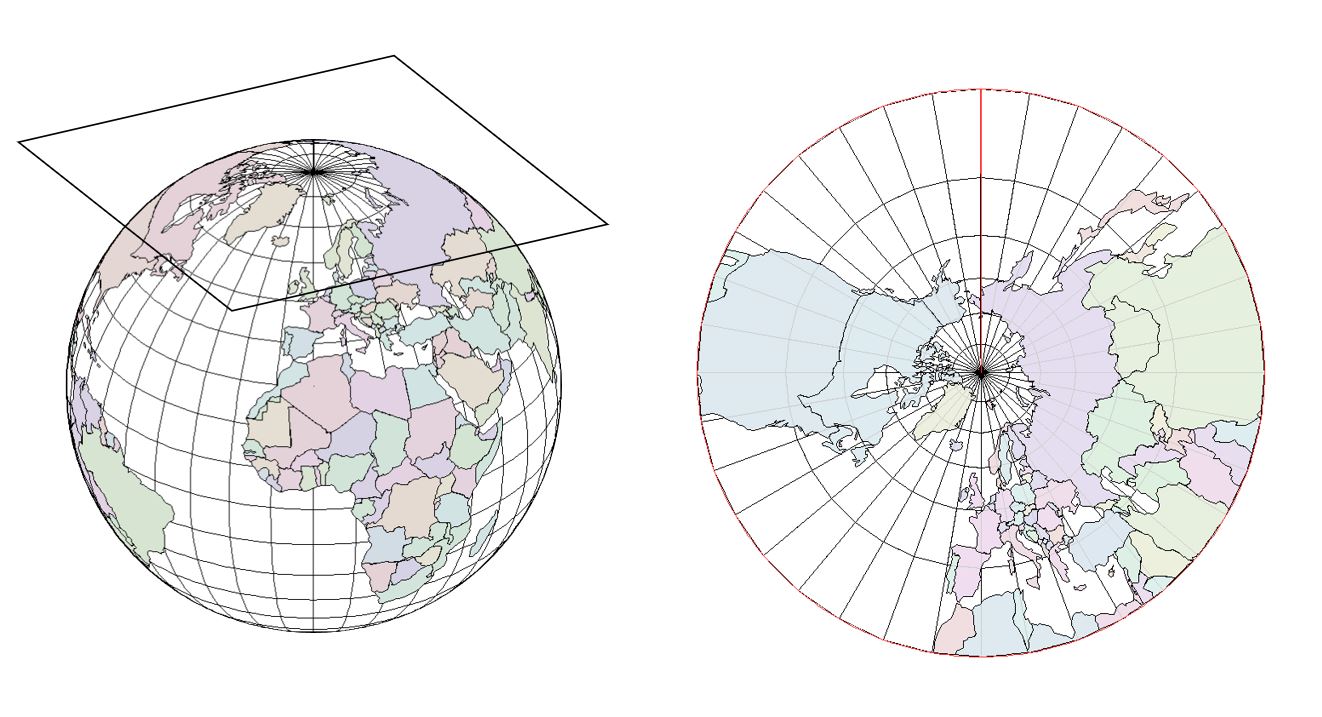

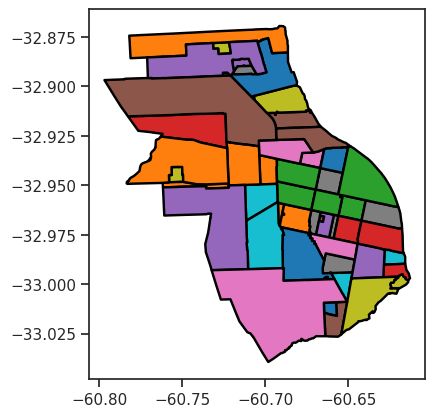

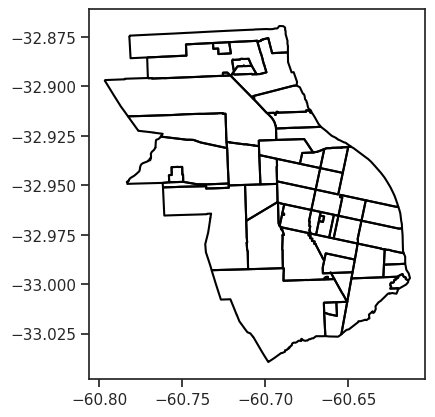

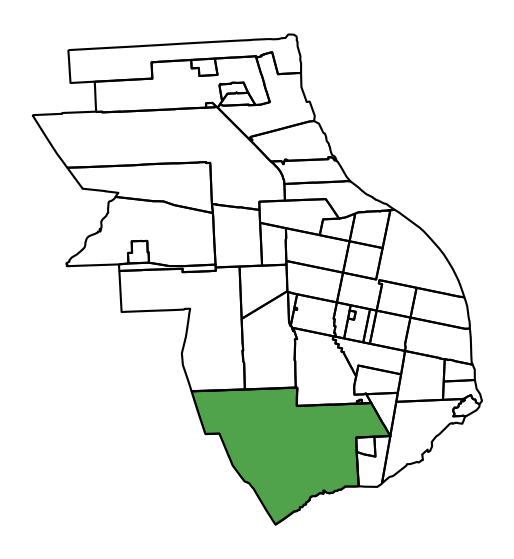

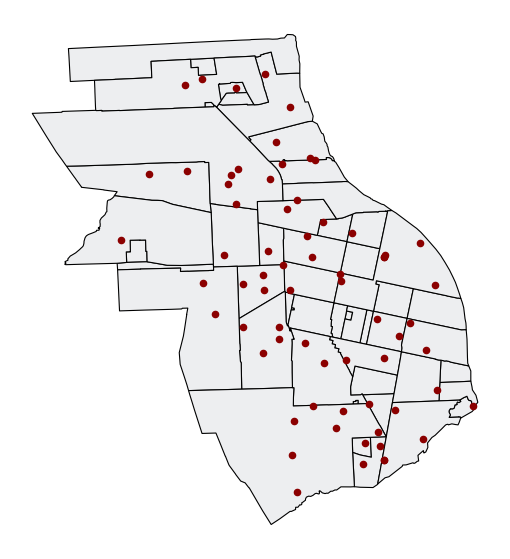

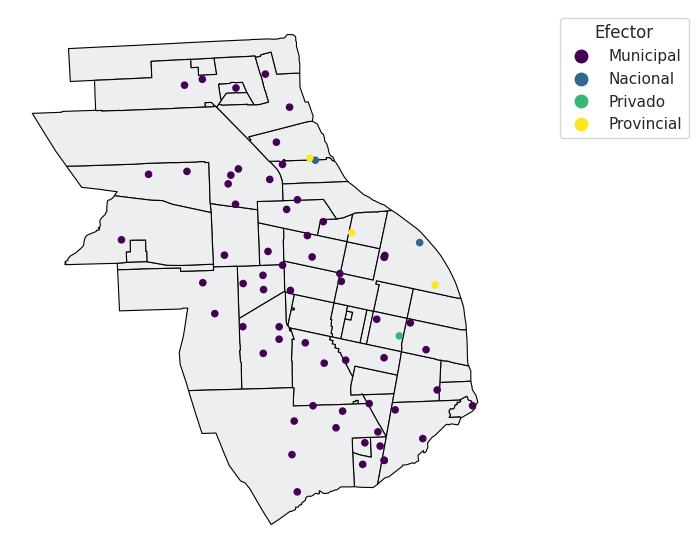

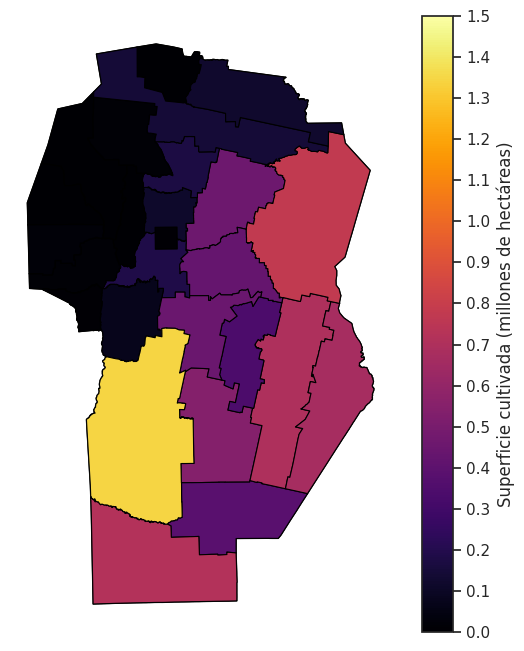

Visualización geoespacial#

Cuando los datos tienen una componente espacial, es posible representarlos sobre mapas. Este tipo de visualización permite analizar distribuciones geográficas, concentraciones espaciales y patrones regionales, y es especialmente relevante en áreas como economía, epidemiología o planificación urbana.

Una variante frecuente es el choropleth: un mapa en el que las regiones se colorean según el valor de una variable. Otra alternativa son los cartogramas, que distorsionan el tamaño de las regiones en función de alguna cantidad de interés (por ejemplo, la población).

Gráficos para visualizar distribuciones#

En la unidad anterior introdujimos herramientas para resumir la distribución de una variable mediante tablas de frecuencias. En esta sección veremos cómo representar esa misma información de forma visual, eligiendo el tipo de gráfico adecuado según las características de la variable.

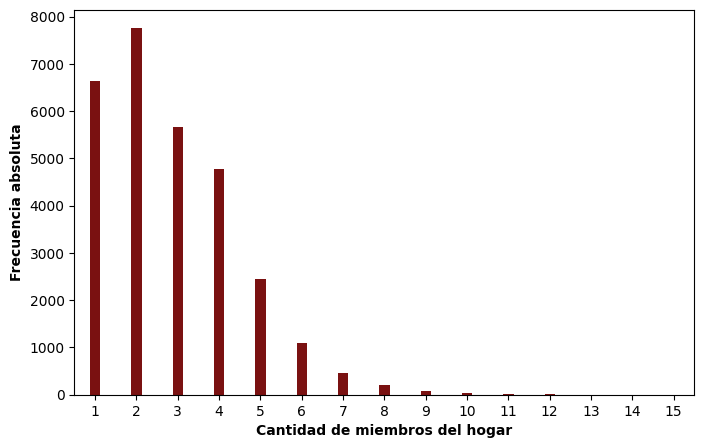

Gráfico de bastones#

Como vimos en la unidad anterior, cuando una variable cuantitativa discreta toma un conjunto acotado de valores distintos, es posible resumir su distribución mediante una tabla de frecuencias donde cada fila corresponde a un valor observado. El gráfico de bastones es la representación visual natural de esa tabla.

En este tipo de gráfico, el eje horizontal representa los valores posibles de la variable y el eje vertical representa su frecuencia (absoluta o relativa). Para cada valor se traza un segmento vertical —el “bastón”— cuya altura es proporcional a dicha frecuencia.

Retomando el dataset de la Encuesta Nacional de Factores de Riesgo 2018, construimos el gráfico de bastones para la variable cant_componentes, que registra la cantidad de miembros del hogar:

import pandas as pd

# Importamos el dataset de la ENFR 2018

data = pd.read_csv('datasets/enfr2018.txt', delimiter = '|')

import matplotlib.pyplot as plt

import seaborn as sns

import numpy as np

plt.figure(figsize = (8,5))

sns.countplot(x = 'cant_componentes', width = 0.25, color = 'darkred', data = data)

plt.xlabel('Cantidad de miembros del hogar', fontweight = 'bold')

plt.ylabel('Frecuencia absoluta', fontweight = 'bold')

plt.show()

El gráfico permite observar con claridad que la distribución es asimétrica hacia la derecha: la mayoría de los hogares tiene pocos miembros, mientras que los hogares con muchos integrantes son progresivamente menos frecuentes.

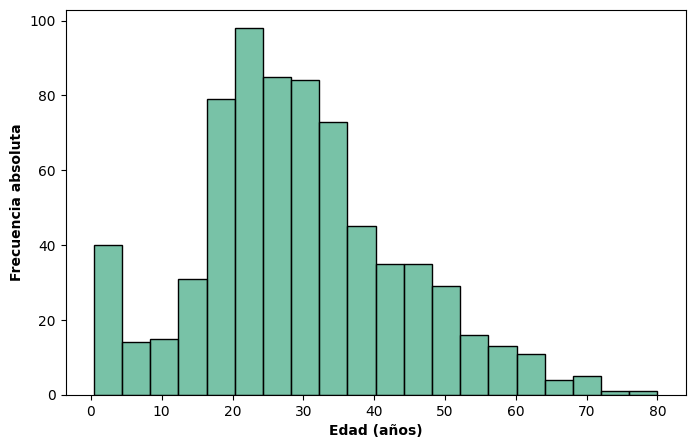

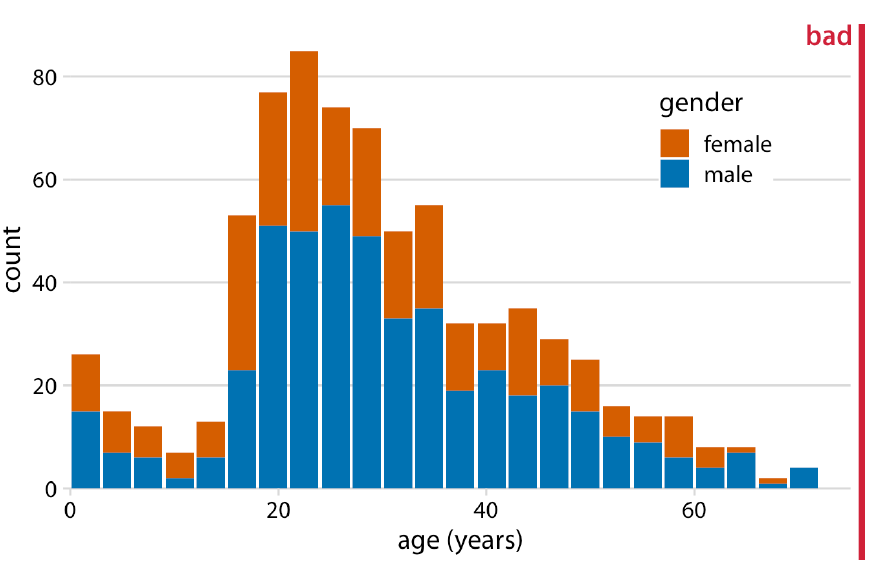

Histograma de frecuencias#

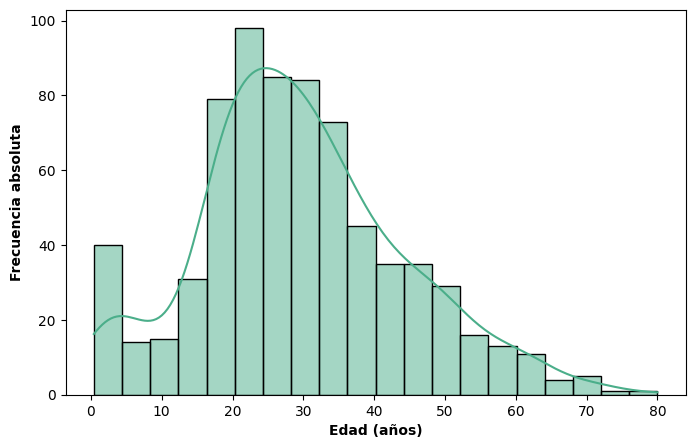

Consideremos ahora la variable edad en el dataset del Titanic. El dataset del Titanic contiene información sobre los pasajeros del famoso transatlántico hundido en 1912. Entre las variables disponibles se encuentran la edad, el sexo, la clase del pasaje, el precio pagado y si el pasajero sobrevivió o no. Es uno de los datasets más utilizados en ciencia de datos, tanto para exploración como para aprendizaje de modelos predictivos.

Podemos importarlo directamente desde la librería seaborn, que incluye algunos datasets de práctica accesibles con la función load_dataset():

data_titanic = sns.load_dataset('titanic')

En este caso, aunque en los datos suele registrarse en años cumplidos, puede asumir un número muy grande de valores distintos. Si intentáramos representar su distribución con un gráfico de bastones, obtendríamos un bastón por cada edad registrada: el gráfico sería difícil de leer y perdería toda utilidad como herramienta de resumen.

Cuando una variable puede tomar muchos valores diferentes —ya sea porque es continua o porque es discreta con un rango amplio— la representación adecuada es el histograma de frecuencias.

A diferencia del gráfico de bastones, el histograma no trabaja con valores puntuales sino con intervalos (llamados bins): agrupa las observaciones en subintervalos contiguos y representa, mediante un rectángulo, la frecuencia de cada uno. El área de cada rectángulo es proporcional a la frecuencia del intervalo correspondiente. Cuando todos los intervalos tienen la misma amplitud (como ocurre habitualmente), la altura de los rectángulos es directamente comparable.

plt.figure(figsize = (8,5))

sns.histplot(x = 'age', edgecolor = 'black', color = '#4BAE8A', data = data_titanic)

plt.xlabel('Edad (años)', fontweight = 'bold')

plt.ylabel('Frecuencia absoluta', fontweight = 'bold')

plt.show()

Personalización del gráfico#

Más allá de la información que transmite, un buen gráfico debe ser claro y estar correctamente etiquetado. En la construcción del histograma anterior ya aparecen algunos elementos de personalización que vale la pena explicitar.

Los títulos de los ejes se agregan con las funciones plt.xlabel() y plt.ylabel() de Matplotlib. El argumento fontweight = 'bold' permite resaltar el texto en negrita; de manera análoga, fontsize controla el tamaño.

El color de las barras se controla mediante el parámetro color de sns.histplot(), que acepta nombres de colores ('red', 'steelblue') o códigos hexadecimales ('#4BAE8A'). El parámetro edgecolor define el color del borde de cada barra, lo que suele mejorar la legibilidad cuando los intervalos son angostos.

El tamaño de la figura se establece con plt.figure(figsize = (ancho, alto)) antes de llamar a la función de graficado, donde los valores están en pulgadas.

Finalmente, plt.show() cierra y renderiza el gráfico de forma explícita, lo que en algunos entornos evita que se muestren mensajes de salida no deseados junto con la figura.

A lo largo de la unidad iremos incorporando otros elementos de personalización según sea necesario.

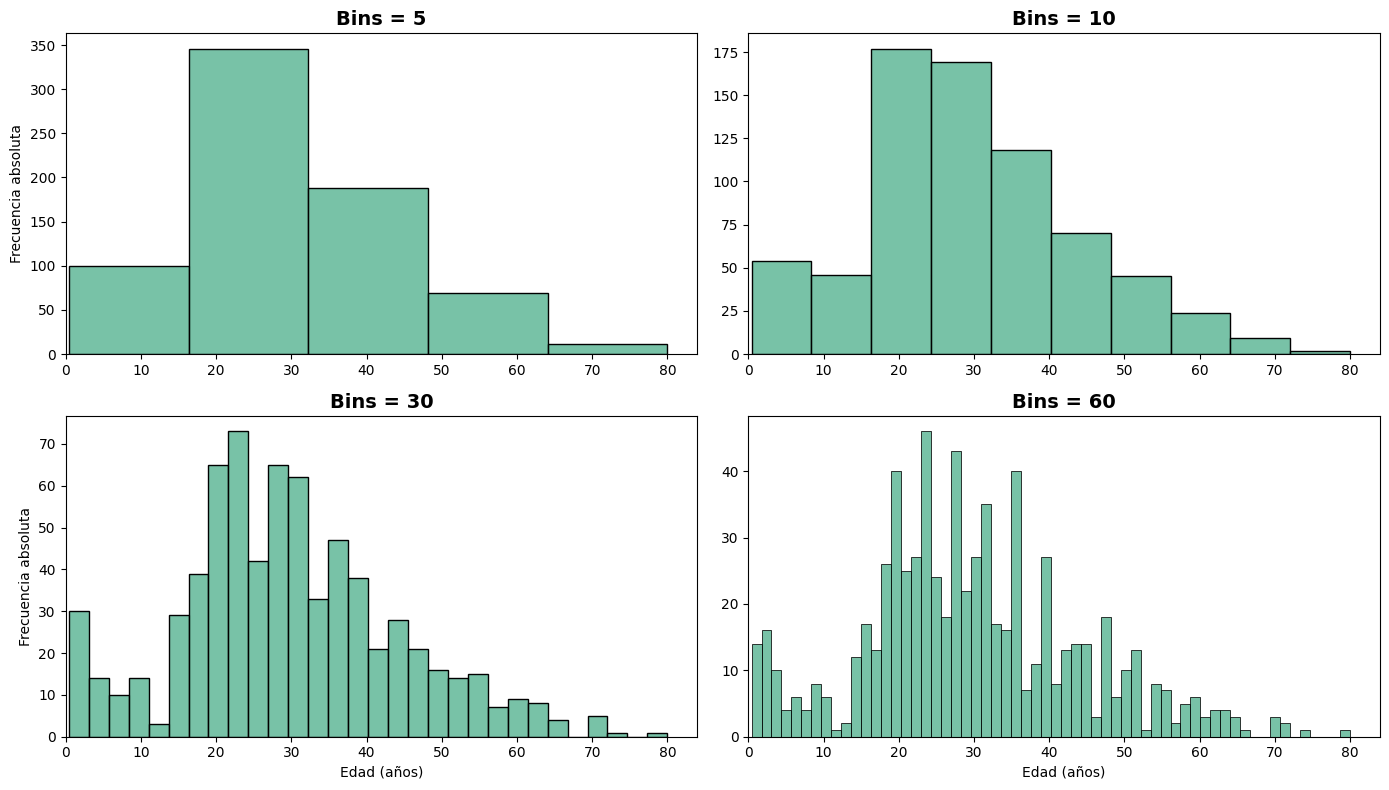

La elección del número de intervalos#

Un aspecto central al construir un histograma es decidir en cuántos intervalos dividir el rango de la variable. Esta decisión no es trivial: afecta directamente la imagen que el gráfico transmite sobre la distribución.

Si se utilizan muy pocos intervalos, se pierde detalle y la distribución puede aparecer más uniforme de lo que realmente es. Si se utilizan demasiados, el gráfico se vuelve ruidoso y difícil de interpretar, con picos y valles que pueden no reflejar ningún patrón real.

El siguiente gráfico muestra el efecto de distintas elecciones de bins sobre el histograma de las edades del Titanic:

fig, axs = plt.subplots(2, 2, figsize = (14, 8))

bins = [5, 10, 30, 60]

for i, (ax, bin_value) in enumerate(zip(axs.flat, bins)):

sns.histplot(x = 'age', edgecolor = 'black', color = '#4BAE8A',

data = data_titanic, bins = bin_value, ax = ax)

ax.set_xlim(left = 0)

ax.set_title(f'Bins = {bin_value}', fontsize = 14, fontweight='bold')

ax.set_xlabel('Edad (años)' if i >= 2 else '')

ax.set_ylabel('Frecuencia absoluta' if i % 2 == 0 else '')

plt.tight_layout()

plt.show()

Por defecto, sns.histplot() calcula automáticamente un número de bins razonable según la cantidad de observaciones. Sin embargo, es posible controlarlo mediante el parámetro bins, que acepta:

un número entero: por ejemplo,

bins = 10el nombre de una regla de referencia:

bins = 'sqrt'(raíz cuadrada de n)una lista con los límites de los intervalos:

bins = [0, 10, 20, 30, 40, 50, 60, 70, 80]

También pueden resultar útiles los parámetros binwidth (para fijar la amplitud de cada intervalo) y binrange (para definir el rango cubierto por el histograma).

Interpretación#

El histograma de edades del Titanic permite observar que la distribución presenta una concentración importante en edades jóvenes y adultas, con una cola hacia la derecha correspondiente a los pasajeros de mayor edad. Esta forma asimétrica sería imposible de detectar con una tabla de frecuencias de valores individuales, y difícilmente apreciable en un gráfico de bastones con tantos valores distintos.

Esto ilustra bien el valor del histograma: no solo resume los datos, sino que revela la forma de la distribución, permitiendo identificar patrones como la asimetría, la concentración de valores o la presencia de múltiples modas.

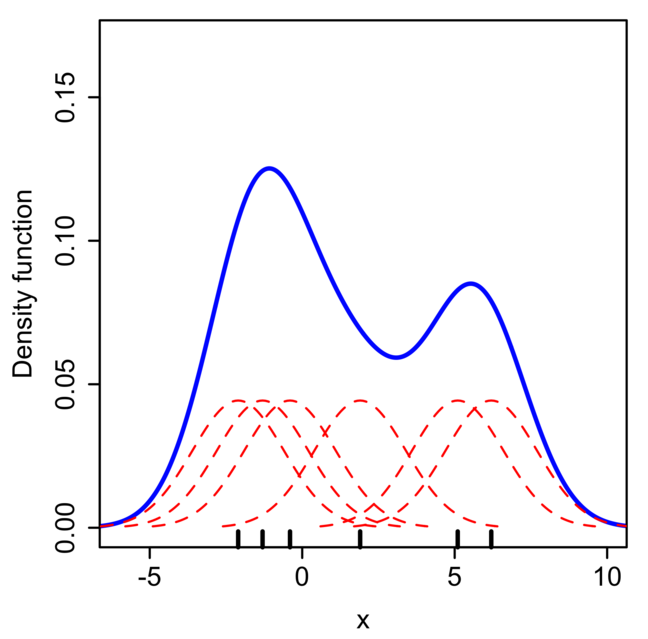

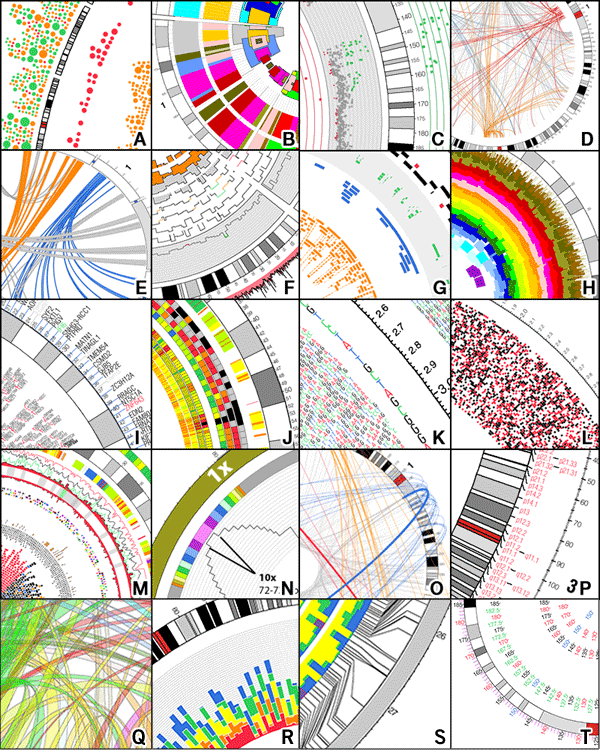

Gráfico de densidad#

El histograma es una herramienta útil para visualizar distribuciones, pero tiene una limitación: su forma depende directamente de la elección del número y el ancho de los intervalos. Una alternativa que evita esta dependencia es el gráfico de densidad, que en lugar de representar frecuencias por intervalos busca estimar la distribución de probabilidad subyacente de los datos mediante una curva continua.

El método de estimación más utilizado es la estimación de densidad por kernel (KDE). La idea es la siguiente: se coloca una curva suave —llamada kernel, representada en la figura a continuación sobre cada observación— centrada en cada observación, y luego se suman todas esas curvas para obtener una estimación global de la densidad. El resultado es una curva continua que describe la forma de la distribución. El kernel más utilizado es el gaussiano, aunque existen otras opciones.

Fig. 14 Ilustración del proceso de estimación de densidad por kernel.#

El parámetro que controla el suavizado de la curva se denomina ancho de banda (bandwidth). Un ancho de banda pequeño produce una curva muy irregular que sigue de cerca cada observación individual; uno grande produce una curva más suave pero que puede ocultar estructura real en los datos.

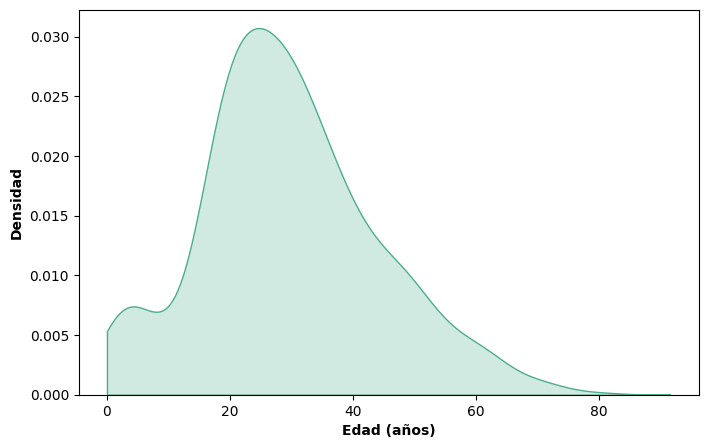

En seaborn, los gráficos de densidad se construyen con la función kdeplot(). Retomando el dataset del Titanic, visualizamos la distribución de edades:

plt.figure(figsize = (8, 5))

sns.kdeplot(x = 'age', fill = True, color = '#4BAE8A', clip = (0, None), data = data_titanic)

plt.xlabel('Edad (años)', fontweight = 'bold')

plt.ylabel('Densidad', fontweight = 'bold')

plt.show()

Notemos el uso del parámetro clip = (0, None): le indica a kdeplot() que restrinja la curva al rango de valores posibles de la variable. Sin este ajuste, la estimación por kernel tiene una tendencia conocida a extenderse más allá del rango real de los datos, generando la apariencia de que existen observaciones donde no las hay. En el caso de la edad, esto se traduce en que la curva podría adentrarse en valores negativos, lo cual carece de sentido. El valor None en el segundo elemento de la tupla indica que no se establece un límite superior.

Importante

Cuando la variable tiene un límite natural —por ejemplo, no puede tomar valores negativos— es importante usar clip para restringir la curva a ese rango. De lo contrario, el gráfico puede comunicar información incorrecta sobre la distribución de los datos.

El parámetro fill = True rellena el área bajo la curva, lo que facilita su lectura. El eje vertical no representa frecuencias sino valores de densidad de probabilidad: dado que el área total bajo la curva es igual a 1, la escala del eje depende de las unidades de la variable representada y no siempre resulta intuitiva. Por ejemplo, si las edades van de 0 a 75 años, la altura media de la curva será del orden de 1/75 ≈ 0.013, lo que explica los valores pequeños que suele mostrar el eje \(Y\).

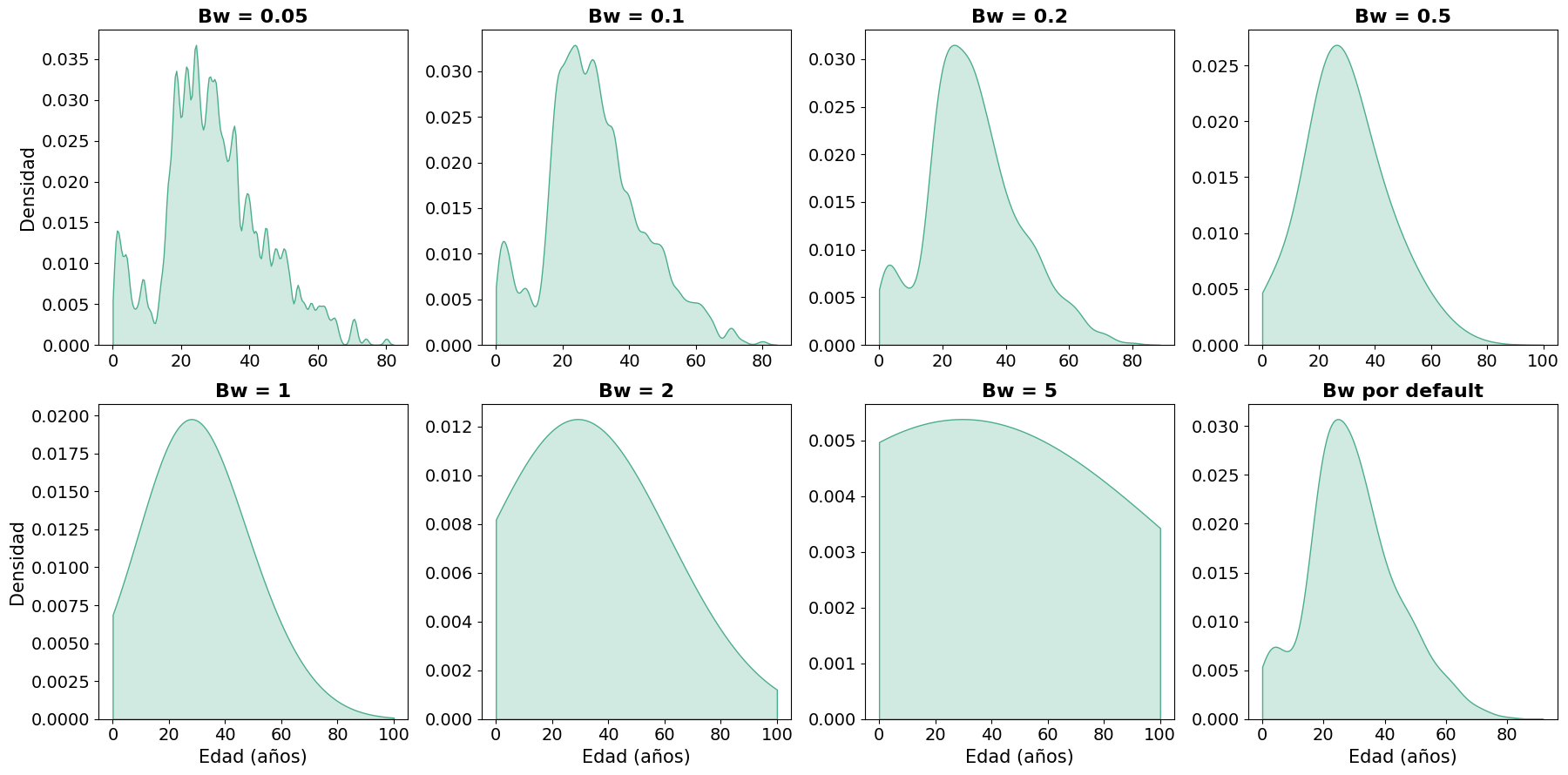

El efecto del ancho de banda#

Al igual que la elección de los bins en el histograma, el ancho de banda afecta directamente la imagen que el gráfico transmite sobre la distribución. El siguiente gráfico muestra el efecto de distintos valores sobre la curva de densidad de las edades del Titanic:

fig, axes = plt.subplots(2, 4, figsize=(18, 9))

bw_values = [0.05, 0.1, 0.2, 0.5, 1, 2, 5, None]

for i, (ax, bw_value) in enumerate(zip(axes.flat, bw_values)):

sns.kdeplot(x = 'age', data = data_titanic, ax = ax,

bw_method = bw_value, color = '#4BAE8A',

fill = True, clip = (0,100))

ax.set(xlabel = '', ylabel = '')

ax.tick_params(axis = 'both', labelsize = 14)

ax.set_title('Bw por default' if bw_value is None else f'Bw = {bw_value}',

fontweight='bold', fontsize = 16)

if i in [0, 4]:

ax.set_ylabel('Densidad', fontsize = 15)

if i in [4, 5, 6, 7]:

ax.set_xlabel('Edad (años)', fontsize = 15)

plt.tight_layout()

plt.show()

Con valores muy pequeños la curva se vuelve ruidosa y difícil de interpretar; con valores muy grandes se aplana hasta perder toda información sobre la estructura de la distribución: por ejemplo, la asimetría hacia la derecha que presenta la distribución de edades desaparece por completo. Wilke señala, además, que el tipo de kernel también influye en la forma de la curva: un kernel gaussiano produce estimaciones con transiciones suaves y colas extendidas, mientras que otros kernels pueden generar escalones o discontinuidades. En general, cuantas más observaciones tiene el dataset, menos importante es la elección del kernel y más robusta resulta la estimación.

Como regla práctica —tanto para histogramas como para gráficos de densidad— conviene explorar distintos valores del parámetro de suavizado para verificar que la forma que muestra el gráfico refleja genuinamente los datos y no es un artefacto de una elección particular.

¿Histograma o gráfico de densidad?#

Ambas representaciones tienen ventajas y limitaciones, y ninguna es universalmente superior. El histograma muestra directamente las frecuencias observadas y es más fácil de interpretar. Por su parte, el gráfico de densidad ofrece una representación más suave y continua, pero introduce supuestos sobre la forma de la distribución que no siempre están justificados.

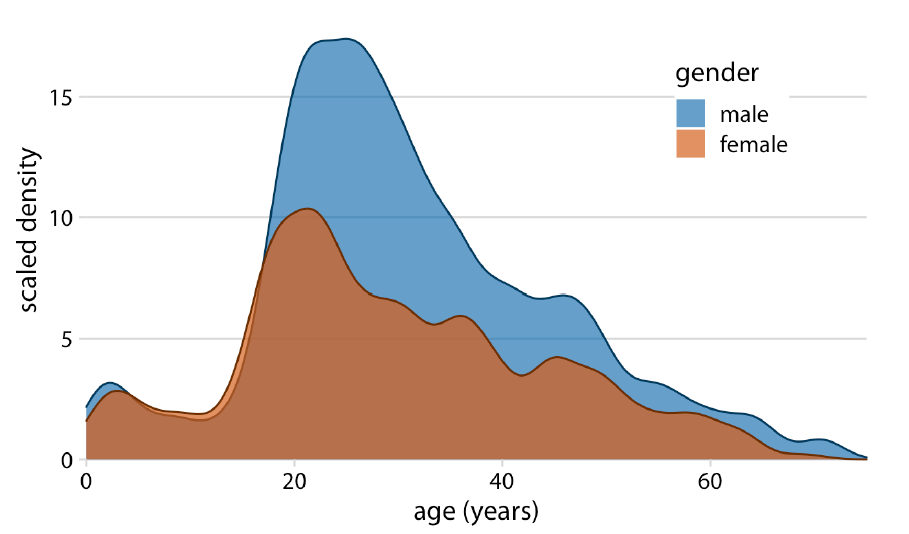

En la práctica, la elección suele depender del contexto y del gusto. Sin embargo, una ventaja clara del gráfico de densidad es que resulta especialmente útil cuando se quieren comparar varias distribuciones al mismo tiempo, ya que superponer múltiples histogramas suele producir gráficos difíciles de leer. Volveremos sobre esto en la siguiente sección.

Histograma con curva de densidad superpuesta#

Una práctica habitual es combinar ambas representaciones superponiendo la curva de densidad al histograma, lo que permite ver simultáneamente las frecuencias observadas y la estimación continua de la distribución. En seaborn esto se logra con el parámetro kde = True dentro de histplot():

plt.figure(figsize = (8, 5))

sns.histplot(x= 'age', kde = True, color = '#4BAE8A', data = data_titanic)

plt.xlabel('Edad (años)', fontweight = 'bold')

plt.ylabel('Frecuencia absoluta', fontweight = 'bold')

plt.show()

Comparar distribuciones entre grupos#

Hasta aquí visualizamos la distribución de una variable de forma global. Sin embargo, en muchos análisis el interés está en comparar cómo se distribuye una variable cuantitativa en distintos grupos definidos por una variable categórica.

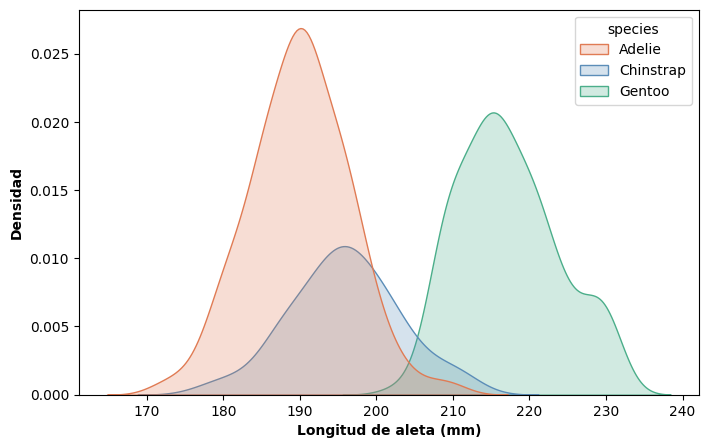

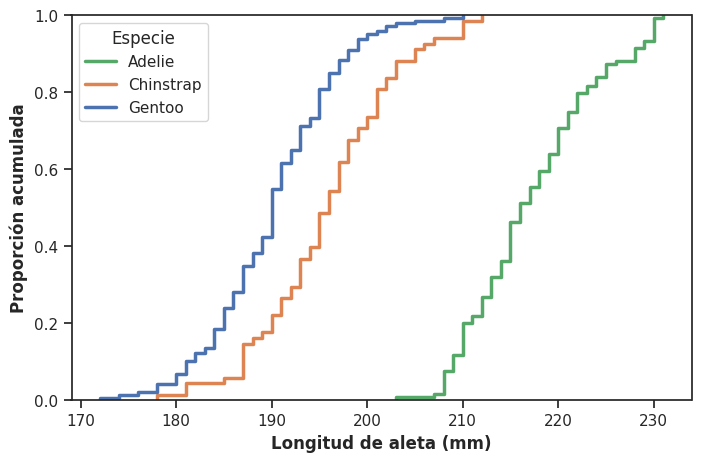

Para ilustrar las distintas alternativas, retomamos el dataset Palmer Penguins y la variable flipper_length_mm, que mide la longitud de aleta de pingüinos de tres especies: Adelie, Chinstrap y Gentoo.

data_penguins = sns.load_dataset('penguins')

Gráficos de densidad múltiples#

Una primera opción es superponer los gráficos de densidad de cada grupo en un mismo panel. En seaborn, esto se logra con el parámetro hue dentro de kdeplot(), que asigna un color distinto a cada categoría, y multiple = 'layer', que superpone las curvas:

paleta_especies = {

'Adelie': '#E07B54',

'Chinstrap': '#5B8DB8',

'Gentoo': '#4BAE8A'

}

plt.figure(figsize = (8, 5))

sns.kdeplot(x = 'flipper_length_mm', hue = 'species',

multiple = 'layer', fill = True, palette = paleta_especies, data = data_penguins)

plt.xlabel('Longitud de aleta (mm)', fontweight = 'bold')

plt.ylabel('Densidad', fontweight = 'bold')

plt.show()

El resultado permite comparar de forma inmediata la forma y posición de cada distribución. Se observa que las tres especies presentan distribuciones claramente diferenciadas: Adelie y Chinstrap tienen aletas más cortas y de longitud similar entre sí, mientras que Gentoo se distingue con aletas notablemente más largas.

Por defecto, kdeplot() utiliza common_norm = True, lo que implica que todas las curvas se normalizan de manera conjunta: el área total bajo todas ellas suma 1. En consecuencia, el área de cada curva es proporcional al tamaño relativo de cada grupo en el dataset. Si en cambio se quisiera comparar únicamente la forma de las distribuciones, sin que intervenga la proporción relativa de las distintas categorías de la variable cualitativa, se puede utilizar common_norm = False. En ese caso, cada curva se normaliza de manera independiente y todas tienen área igual a 1.

Para verificar cómo se distribuyen las observaciones entre las especies, podemos calcular el porcentaje que representa cada una sobre el total:

#|echo: true

#|output: true

#|code-line-numbers: false

data_penguins['species'].value_counts(normalize = True).mul(100).round(2)

species

Adelie 44.19

Gentoo 36.05

Chinstrap 19.77

Name: proportion, dtype: float64

Esto permite incorporar información sobre el tamaño relativo de cada grupo. Sin embargo, esa diferencia no siempre es fácil de percibir visualmente: en este caso, se distingue con mayor claridad que Chinstrap es la especie menos numerosa, mientras que la mayor proporción de Adelie no resulta tan evidente a simple vista. Aun así, esta versión comunica simultáneamente la forma de cada distribución y el peso relativo de cada grupo dentro del total.

Sin embargo, los gráficos de densidad superpuestos tienen una limitación práctica: cuando el número de grupos crece, las curvas se acumulan y el gráfico se vuelve difícil de leer. Para esos casos existen alternativas más adecuadas.

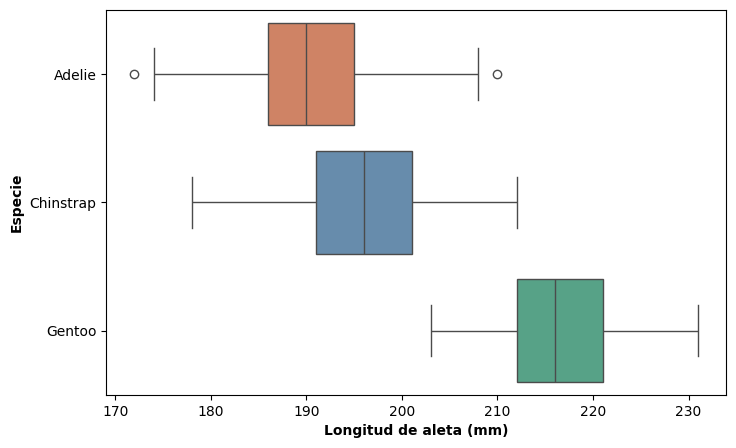

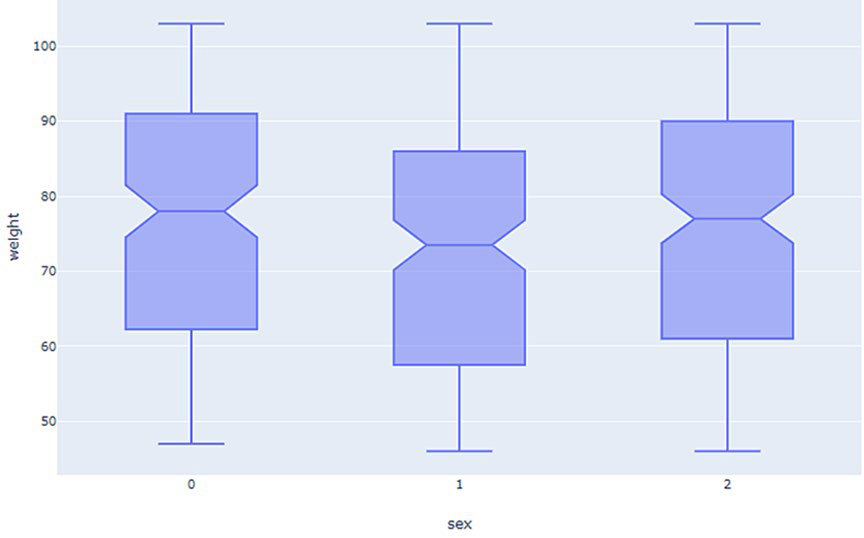

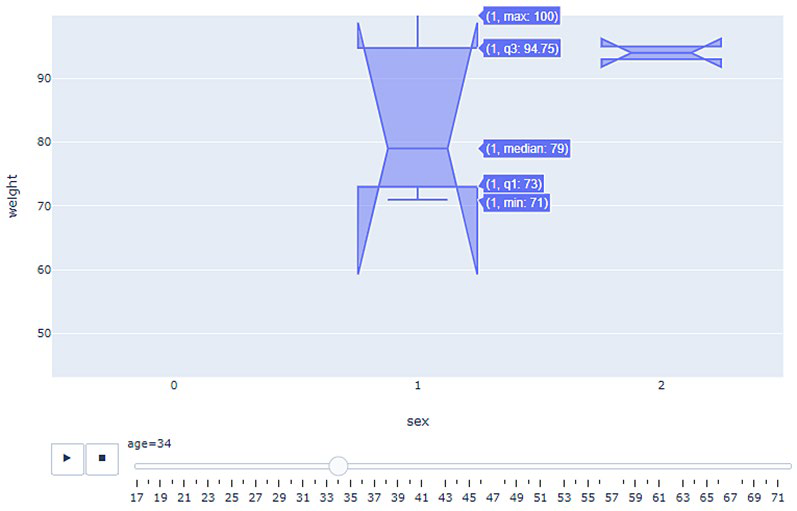

Boxplot múltiple#

El boxplot, que ya introdujimos como herramienta para resumir una única distribución, resulta especialmente útil cuando se quieren comparar varias distribuciones al mismo tiempo. Al colocar varios boxplots uno al lado del otro es posible comparar de un vistazo la mediana, la dispersión y la presencia de valores atípicos en cada grupo.

En seaborn, esto se logra mapeando la variable categórica al parámetro y:

orden = (data_penguins.groupby('species')['flipper_length_mm']

.median()

.sort_values()

.index)

plt.figure(figsize = (8, 5))

sns.boxplot(x = 'flipper_length_mm', y = 'species',

hue = 'species', palette = paleta_especies, order = orden, data = data_penguins)

plt.xlabel('Longitud de aleta (mm)', fontweight = 'bold')

plt.ylabel('Especie', fontweight = 'bold')

plt.show()

Las categorías se ordenan según la mediana de la variable respuesta en lugar de dejarse en orden alfabético. Esta práctica facilita la lectura y hace más evidente el ordenamiento entre grupos.

El boxplot tiene, sin embargo, una limitación importante: resume la distribución en cinco números y puede ocultar su forma real o subyacente. Dos distribuciones con la misma mediana y el mismo rango intercuartílico pueden tener formas muy distintas —una unimodal y simétrica, otra bimodal o sesgada— y un boxplot las haría aparecer idénticas.

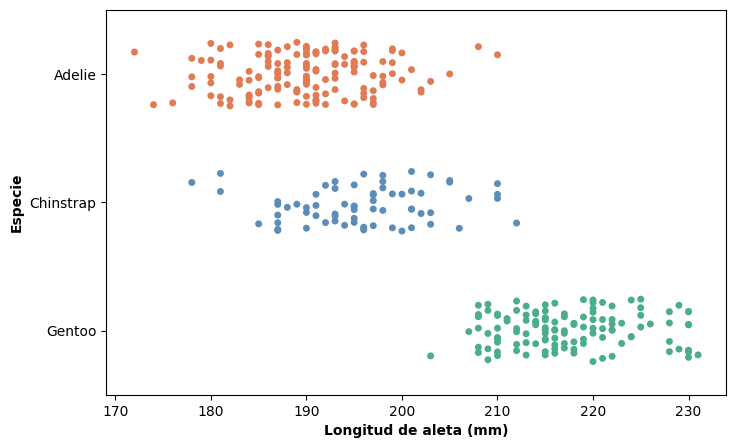

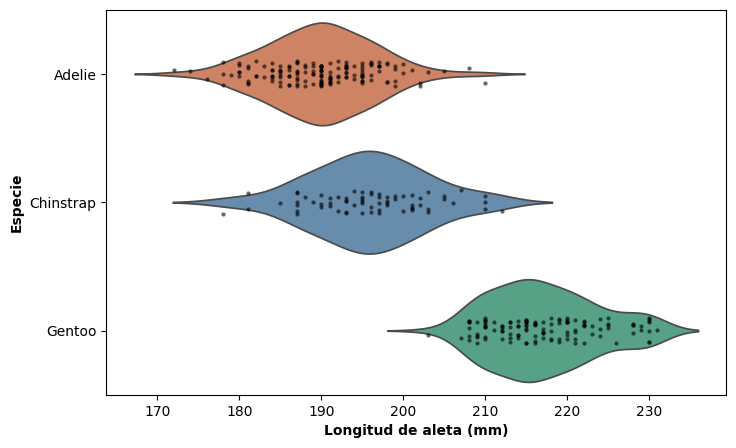

Strip plot#

Una alternativa que evita este problema es el strip plot (también llamado jitter plot), que representa directamente cada observación como un punto. Al mostrar los datos individuales, este gráfico no oculta ninguna información sobre la distribución.

Cuando hay muchas observaciones, representarlas en una línea exacta provoca superposición y dificulta la lectura. Por eso se aplica jittering: se agrega un pequeño desplazamiento aleatorio en la dimensión perpendicular al eje de la variable respuesta, de modo que los puntos se dispersen sin distorsionar los valores reales.

plt.figure(figsize = (8, 5))

sns.stripplot(x = 'flipper_length_mm', y = 'species',

hue = 'species', palette = paleta_especies, order = orden,

jitter = 0.25, data = data_penguins)

plt.xlabel('Longitud de aleta (mm)', fontweight = 'bold')

plt.ylabel('Especie', fontweight = 'bold')

plt.show()

El strip plot es preferible cuando el número de observaciones es moderado y se quiere mostrar la distribución completa. Con datasets muy grandes, incluso con jittering puede volverse difícil de leer.

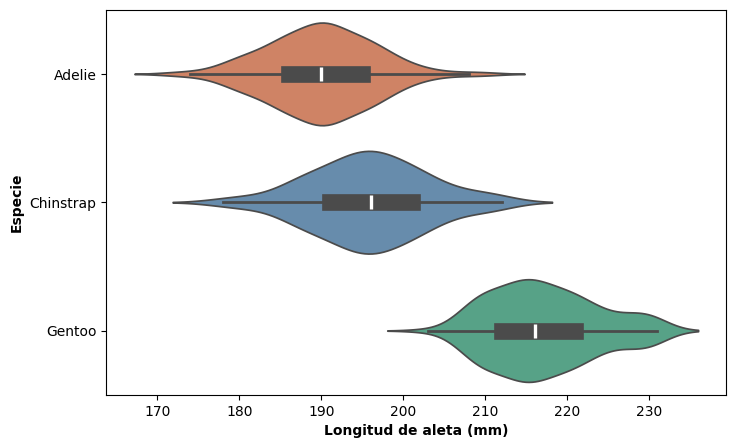

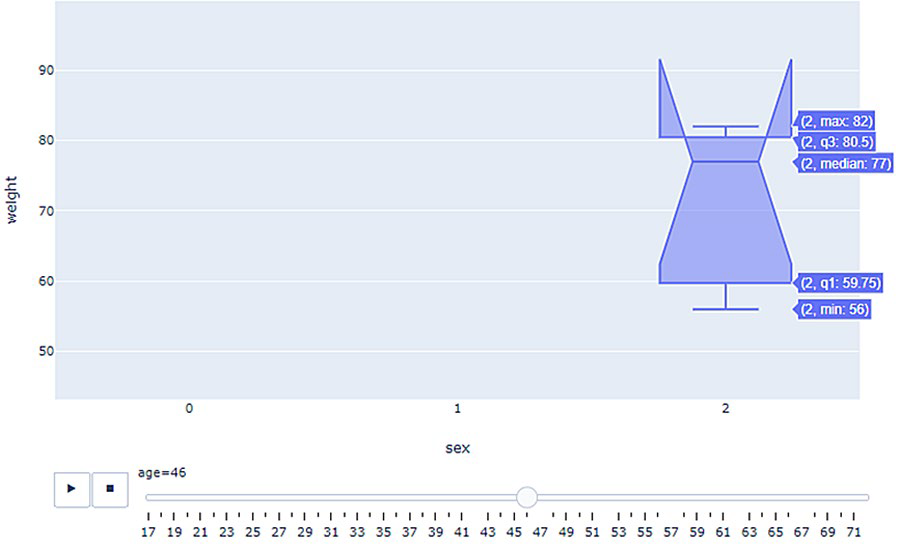

Violin plot#

El gráfico de violín combina las ventajas del boxplot y del gráfico de densidad. Técnicamente, es una estimación de densidad por kernel rotada 90 grados y reflejada, lo que produce una figura simétrica cuyo ancho en cada punto es proporcional a la densidad de observaciones en ese valor.

A diferencia del boxplot, el violin plot puede revelar distribuciones bimodales o asimétricas que el boxplot ocultaría. Sin embargo, hereda la principal limitación del gráfico de densidad: cuando el número de observaciones en algún grupo es pequeño, la curva puede sugerir estructura donde no la hay. Por eso, antes de usar un violin plot conviene verificar que cada grupo cuenta con suficientes observaciones.

plt.figure(figsize = (8, 5))

sns.violinplot(x = 'flipper_length_mm', y = 'species',

hue = 'species', palette = paleta_especies, order = orden,

inner_kws = dict(box_width = 12, whis_width = 2),

data = data_penguins)

plt.xlabel('Longitud de aleta (mm)', fontweight = 'bold')

plt.ylabel('Especie', fontweight = 'bold')

plt.show()

Por defecto, violinplot() incluye un boxplot interno que resume los cuartiles y la mediana. Esto puede controlarse con el parámetro inner: usando inner = None se oculta, y con inner_kws se puede ajustar su grosor y apariencia.

Una combinación especialmente informativa es superponer el strip plot sobre el violin plot con inner = None, obteniendo simultáneamente la estimación de la forma de la distribución y la visualización de cada observación individual:

plt.figure(figsize=(8, 5))

sns.violinplot(x = 'flipper_length_mm', y = 'species',

hue = 'species', palette = paleta_especies, order = orden,

inner = None, data = data_penguins)

sns.stripplot(x = 'flipper_length_mm', y = 'species',

order = orden, data = data_penguins,

color = 'black', size = 3, alpha = 0.6,

jitter = True)

plt.xlabel('Longitud de aleta (mm)', fontweight = 'bold')

plt.ylabel('Especie', fontweight = 'bold')

plt.show()

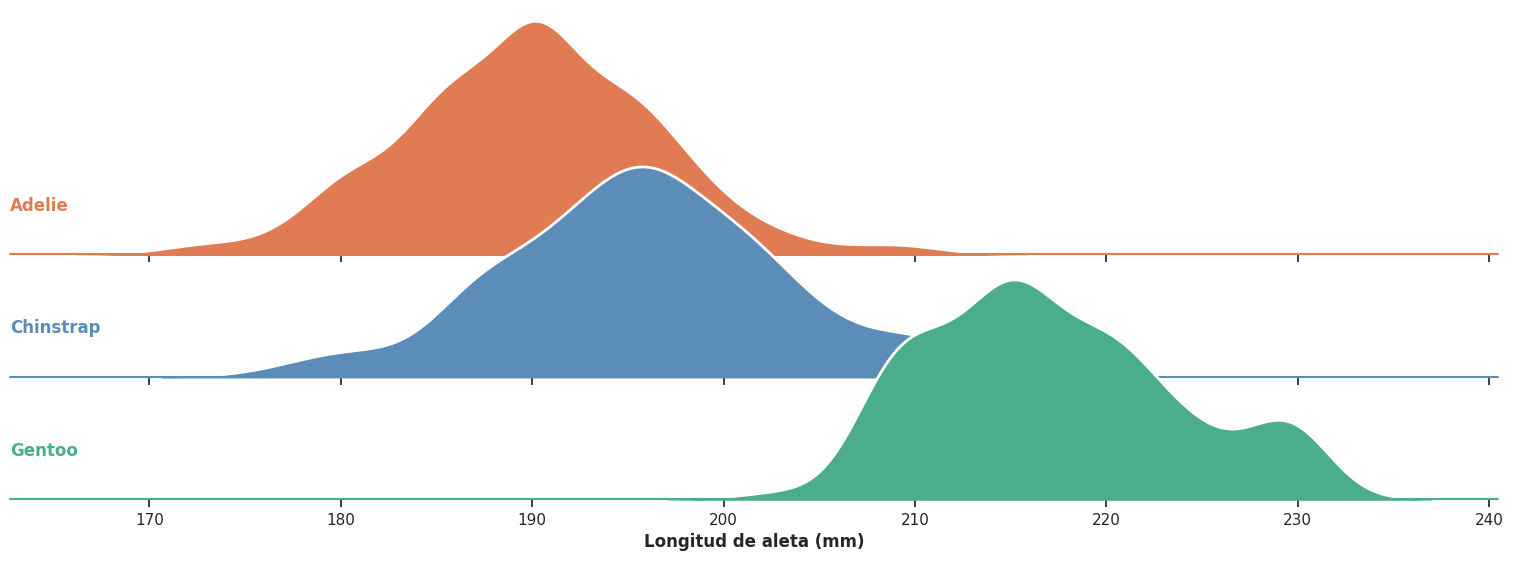

Ridgeline plot#

Cuando el número de grupos es grande, los gráficos anteriores pueden volverse difíciles de leer: los boxplots o violines apilados se comprimen y pierden legibilidad. En esos casos, el ridgeline plot ofrece una alternativa más efectiva.

Un ridgeline plot muestra las distribuciones de cada grupo como curvas de densidad escalonadas en el eje vertical, superponiéndose ligeramente entre sí. Este tipo de gráfico es especialmente útil cuando se tienen muchos grupos o cuando se quiere visualizar la evolución de distribuciones a lo largo del tiempo.

Para el ejemplo de Penguins el número de grupos es pequeño y cualquiera de las opciones anteriores funciona bien. Sin embargo, es una buena oportunidad para conocer esta herramienta. Puede construirse directamente con seaborn combinando un FacetGrid con kdeplot():

sns.set_theme(style = 'ticks', rc = {'axes.facecolor': (0, 0, 0, 0)})

g = sns.FacetGrid(

data_penguins,

row = 'species',

hue = 'species',

row_order = orden,

aspect = 8,

height = 2,

palette = paleta_especies

)

g.map(sns.kdeplot, 'flipper_length_mm',

bw_adjust = 0.8, fill = True, alpha = 1, linewidth = 1.5, clip_on = False)

g.map(sns.kdeplot, 'flipper_length_mm',

bw_adjust = 0.8, color = 'white', lw = 2, clip_on = False)

g.refline(y = 0, linewidth = 1.5, linestyle = '-', color = None, clip_on = False)

def label(x, color, label):

ax = plt.gca()

ax.text(0, 0.2, label, fontweight = 'bold', color = color,

ha = 'left', va = 'center', transform = ax.transAxes)

g.map(label, 'flipper_length_mm')

g.figure.subplots_adjust(hspace = -0.5)

g.set_titles('')

g.set(yticks = [], ylabel = '')

g.despine(bottom = True, left = True)

g.set_xlabels('Longitud de aleta (mm)', fontweight = 'bold')

plt.show()

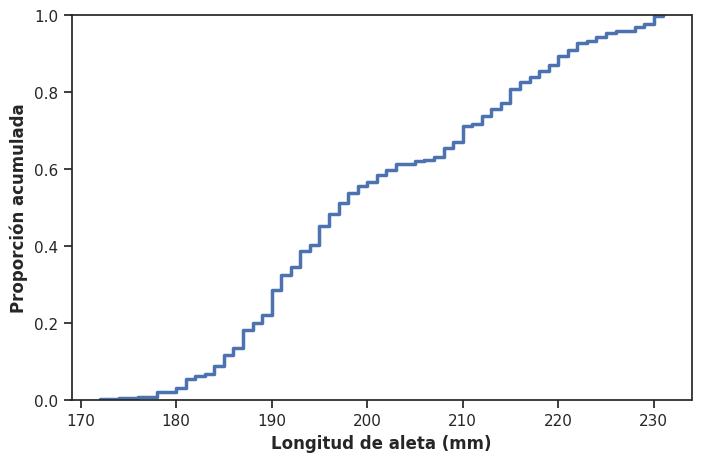

Función de distribución acumulada empírica (ECDF)#

Los histogramas y los gráficos de densidad que vimos en las secciones anteriores son herramientas poderosas e intuitivas para explorar la forma de una distribución. Sin embargo, ambas comparten una limitación importante: el aspecto final del gráfico depende de decisiones que toma el analista de datos —por ejemplo, el ancho de los bins en el histograma, el bandwidth en la estimación de densidad— y esas decisiones pueden afectar de forma significativa lo que el gráfico comunica. En ese sentido, tanto el histograma como el gráfico de densidad son, en alguna medida, una interpretación de los datos, no una representación directa de ellos.

La función de distribución acumulada empírica (ECDF, por sus siglas en inglés) resuelve este problema. No requiere ningún parámetro de suavizado, no depende de decisiones arbitrarias del analista y muestra todos los datos al mismo tiempo. La contrapartida es que resulta algo menos intuitiva al primer contacto, razón por la cual es mucho más frecuente en publicaciones técnicas y en la práctica estadística que en la comunicación general de datos.

La idea detrás de la ECDF es simple: para cada valor posible \(x_0\) en el rango de los datos, la función nos dice qué proporción de las observaciones es menor o igual a \(x_0\). Dicho de otro modo, si ordenamos todas las observaciones de menor a mayor y las numeramos del 1 al \(n\) la ECDF asigna a cada observación su rango relativo dentro del total.

Para ilustrarlo con un ejemplo concreto usaremos la variable flipper_length_mm (longitud de la aleta en milímetros), incluida en el dataset Penguins, y construiremos el gráfico utilizando la función sns.ecdfplot() de la librería Seaborn:

# Eliminamos cualquier registro que contenga un dato faltante

data_penguins = data_penguins.dropna()

plt.figure(figsize=(8, 5))

sns.ecdfplot(x = 'flipper_length_mm', linewidth = 2.5, data = data_penguins)

plt.xlabel('Longitud de aleta (mm)', fontweight = 'bold')

plt.ylabel('Proporción acumulada', fontweight = 'bold')

plt.show()

La curva resultante es siempre monótona creciente: parte de 0 en el valor mínimo de los datos y llega a 1 en el valor máximo. Su forma nos permite leer directamente propiedades de la distribución que en un histograma requieren más esfuerzo. Por ejemplo, el valor en el que la curva cruza el 0.5 en el eje vertical corresponde a la mediana. Si la curva crece de forma muy abrupta en una región, significa que muchas observaciones se concentran allí. Si crece lentamente, los datos están más dispersos en ese rango.

También podemos usar la ECDF para comparar distribuciones entre grupos, simplemente graficando una curva por grupo:

plt.figure(figsize=(8, 5))

sns.ecdfplot(x = 'flipper_length_mm', hue = 'species', linewidth = 2.5, data = data_penguins)

plt.xlabel('Longitud de aleta (mm)', fontweight = 'bold')

plt.ylabel('Proporción acumulada', fontweight = 'bold')

plt.legend(title = 'Especie', labels = ['Adelie', 'Chinstrap', 'Gentoo'], facecolor = 'white')

plt.show()

Esta comparación tiene una ventaja sobre los gráficos de densidad por grupo: al no requerir suavizado, no existe el riesgo de que las curvas de distintos grupos se “contaminen” visualmente entre sí. Cada ECDF representa fielmente los datos de su grupo, sin interpolación.

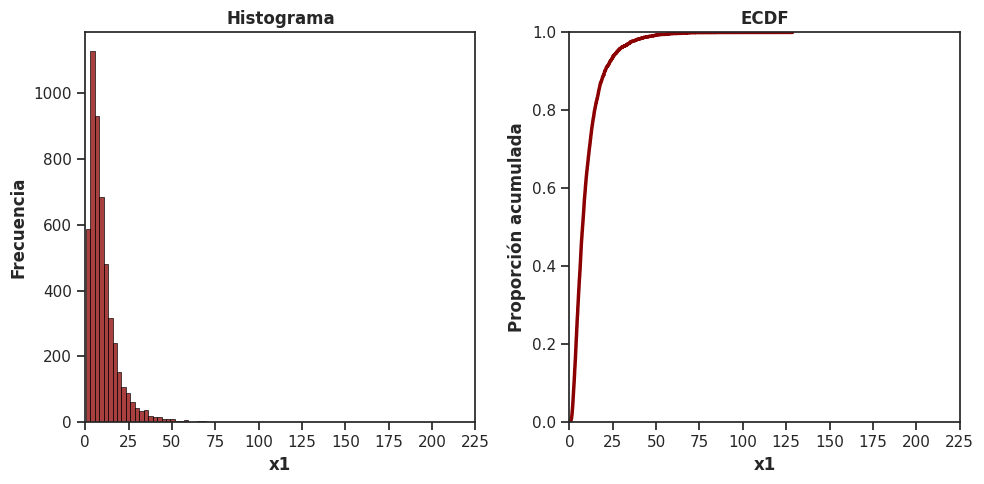

ECDF y distribuciones muy asimétricas#

La ECDF resulta especialmente útil cuando los datos tienen distribuciones muy asimétricas, es decir, con una cola larga hacia la derecha. En esos casos, los histogramas y las densidades suelen mostrar un pico pronunciado cerca del mínimo y un eje horizontal tan extendido que los detalles de la distribución desaparecen.

Un ejemplo clásico es la distribución de ingresos, precios de viviendas, o tamaños de ciudades. Para ilustrarlo, vamos a simular datos provenientes de una distribución muy asimétrica (datos_x1):

# Simulamos datos muy asimétricos (distribución lognormal)

np.random.seed(123)

datos_x1 = np.random.lognormal(mean = 2, sigma = 0.8, size = 5000)

fig, axes = plt.subplots(1, 2, figsize = (10, 5))

# Histograma

sns.histplot(x = datos_x1, color = 'darkred', edgecolor = 'black', bins = 50, ax = axes[0])

axes[0].set_xlabel('x1', fontweight = 'bold')

axes[0].set_ylabel('Frecuencia', fontweight = 'bold')

axes[0].set_title('Histograma', fontweight = 'bold')

axes[0].set_xticks(np.arange(0, 226, 25))

axes[0].set_xlim(0, 225)

# ECDF

sns.ecdfplot(x = datos_x1, linewidth = 2.5, color = 'darkred', ax = axes[1])

axes[1].set_xlabel('x1', fontweight = 'bold')

axes[1].set_ylabel('Proporción acumulada', fontweight = 'bold')

axes[1].set_title('ECDF', fontweight = 'bold')

axes[1].set_xticks(np.arange(0, 226, 25))

axes[1].set_xlim(0, 225)

plt.tight_layout()

plt.show()

Comparar ambos gráficos lado a lado es un ejercicio revelador. El histograma muestra claramente la asimetría pero hace difícil leer valores concretos. La ECDF, en cambio, permite ver directamente qué proporción de los valores de la variable son menores o iguales a un determinado valor, o identificar los percentiles de la distribución con precisión.

Cuando la asimetría es muy extrema, puede ser útil aplicar una transformación logarítmica al eje horizontal antes de graficar la ECDF. Esto “abre” la distribución y hace visibles detalles que de otro modo quedarían aplastados cerca del mínimo.

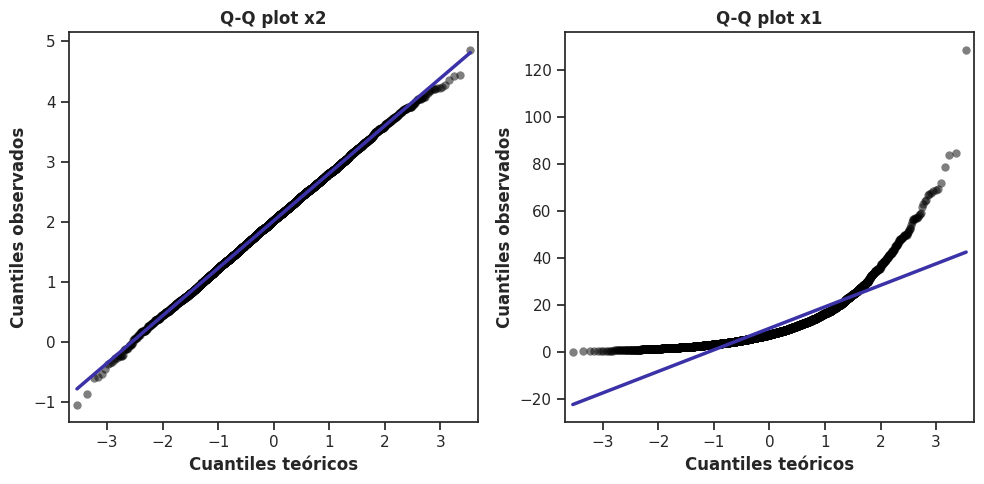

Gráficos Q-Q#

Los gráficos cuantil-cuantil (Q-Q plots) son una herramienta de diagnóstico estadístico: no están pensados para explorar la forma de una distribución en términos generales, sino para responder una pregunta más específica: ¿qué tan bien se ajustan mis datos a una distribución teórica particular?

La distribución de referencia más habitual es la distribución normal, aunque el principio es general y puede aplicarse a cualquier distribución teórica.

La lógica del gráfico es la siguiente: si los datos siguieran perfectamente una distribución normal, entonces sus cuantiles empíricos deberían coincidir exactamente con los cuantiles teóricos de esa distribución. El Q-Q plot compara visualmente ambos conjuntos de cuantiles: si los puntos caen sobre la diagonal, los datos se ajustan bien a la distribución de referencia. Las desviaciones sistemáticas respecto a la línea pueden revelar algunas diferencias específicas con respecto a la referencia: colas más pesadas o más ligeras de lo esperado, asimetría, valores atípicos, etc.

Para construir un Q-Q plot en Python podemos usar la función sm.qqplot() de la librería statsmodels. A modo de ejemplo, vamos a comparar el Q-Q plot de los datos de la variable \(x_1\) (generada anteriormente) con el de una variable \(x_2\), generada a partir de una distribución normal.

# Simulamos datos provenientes de una distribución normal

np.random.seed(123)

datos_x2 = np.random.normal(loc = 2, scale = 0.8, size = 5000)

import statsmodels.api as sm

fig, axes = plt.subplots(1, 2, figsize = (10, 5))

# Variable aproximadamente normal: x2

sm.qqplot(datos_x2, line = 's', ax = axes[0], markerfacecolor = 'black', markeredgecolor = 'none', alpha = 0.5)

axes[0].set_title('Q-Q plot x2', fontweight = 'bold')

axes[0].set_xlabel('Cuantiles teóricos', fontweight = 'bold')

axes[0].set_ylabel('Cuantiles observados', fontweight = 'bold')

axes[0].lines[1].set_color('#3c32a8')

axes[0].lines[1].set_linewidth(2.5)

# Variable asimétrica: x1

sm.qqplot(datos_x1, line = 's', ax = axes[1], markerfacecolor = 'black', markeredgecolor = 'none', alpha = 0.5)

axes[1].set_title('Q-Q plot x1', fontweight = 'bold')

axes[1].set_xlabel('Cuantiles teóricos', fontweight = 'bold')

axes[1].set_ylabel('Cuantiles observados', fontweight = 'bold')

axes[1].lines[1].set_color('#3c32a8')

axes[1].lines[1].set_linewidth(2.5)

plt.tight_layout()

plt.show()

El contraste entre ambos paneles es inmediatamente elocuente. Los datos de la variable \(x_2\) siguen muy de cerca la diagonal, lo que indica que su distribución es aproximadamente normal. Los datos de \(x_1\), en cambio, muestran una desviación muy marcada.

¿Cuándo usar ECDF y cuándo usar Q-Q plots?#

Ambas herramientas son complementarias y responden a preguntas distintas. La ECDF es ideal para explorar la distribución de los datos: muestra todo el rango de valores, permite comparar grupos y es útil para leer percentiles directamente. El Q-Q plot, en cambio, es una herramienta de diagnóstico: sirve para evaluar si los datos se ajustan a una distribución teórica específica, y es más sensible a desviaciones en las colas de la distribución que un histograma o una densidad.

En la práctica, la secuencia habitual es: explorar con histograma o densidad, confirmar o refinar con ECDF, y validar supuestos distribucionales con Q-Q plots antes de aplicar modelos estadísticos que los requieran.

Gráficos para visualizar conteos y proporciones#

Hasta aquí trabajamos principalmente con variables cuantitativas. Cuando la variable de interés es cualitativa, el objetivo cambia: ya no buscamos describir una forma continua, sino comparar frecuencias o proporciones entre categorías.

La herramienta central para este tipo de análisis es el gráfico de barras.

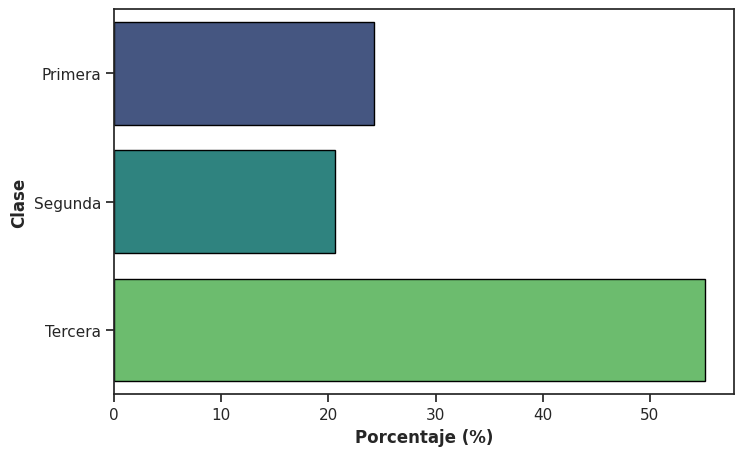

Gráfico de barras#

En un gráfico de barras cada categoría se representa mediante una barra cuya longitud es proporcional a la frecuencia de observaciones en esa categoría. Es, en esencia, la representación visual de una tabla de frecuencias para una variable cualitativa.

En seaborn, esto se implementa con countplot(). Por defecto muestra frecuencias absolutas, pero puede representar frecuencias relativas utilizando el argumento stat = 'proportion' o porcentajes utilizando stat = 'percent'. Retomando el dataset del Titanic, visualizamos la distribución de pasajeros según la clase en la que viajaban:

# Definimos paletas de colores para los gráficos

colors_v = sns.color_palette('viridis', 2)

colors_m = sns.color_palette('magma', 2)

plt.figure(figsize = (8, 5))

sns.countplot(y = 'class', stat = 'percent',

order = ['First', 'Second', 'Third'],

palette = 'viridis',

edgecolor = 'black',

data = data_titanic)

plt.xlabel('Porcentaje (%)', fontweight = 'bold')

plt.ylabel('Clase', fontweight = 'bold')

plt.yticks(ticks = range(3),

labels = ['Primera', 'Segunda', 'Tercera'])

plt.show()

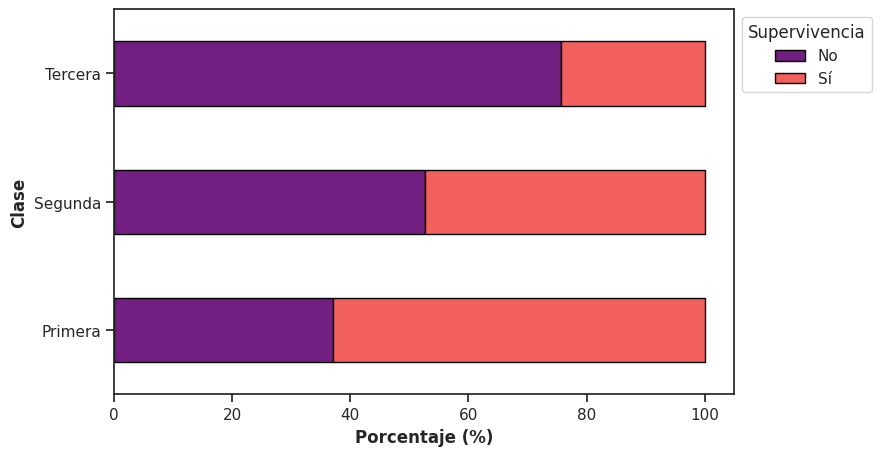

El gráfico permite observar de un vistazo cómo era la distribución de los pasajeros del barco entre las tres clases: más de la mitad viajaba en tercera clase. Se trata de la representación visual de la siguiente tabla:

data_titanic['class'].value_counts(normalize = True).mul(100).round(1).rename('percent')

class

Third 55.1

First 24.2

Second 20.7

Name: percent, dtype: float64

Nótese que las categorías se ordenan explícitamente con el parámetro order en lugar de dejar el orden por defecto. Igual que con los boxplots, ordenar las barras según el valor representado —de mayor a menor, o siguiendo algún criterio sustantivo— facilita la lectura y hace más evidentes las diferencias entre grupos.

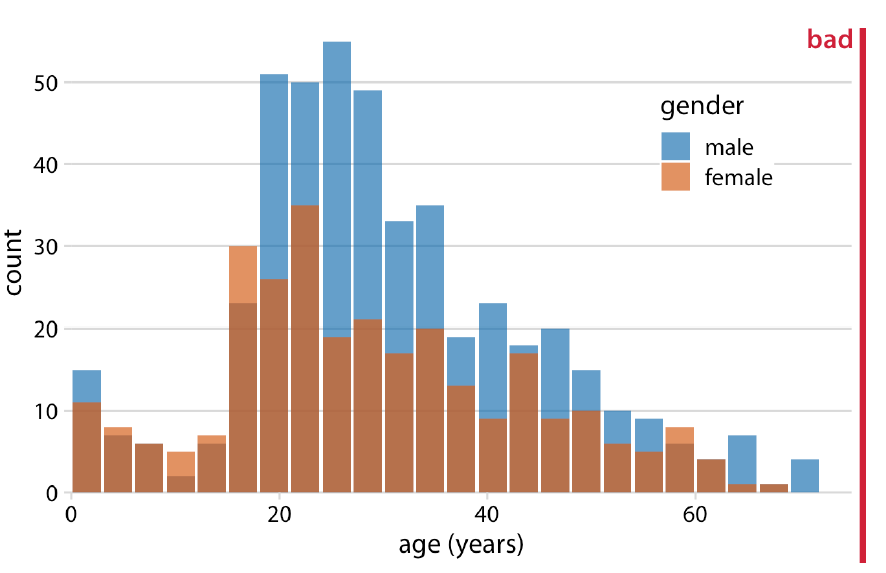

Barras agrupadas#

Muchas veces el interés no está en una sola variable categórica, sino en analizar la relación entre dos. Una forma directa de hacerlo es con un gráfico de barras agrupadas, que coloca en paralelo las barras de cada combinación de categorías.

En seaborn, esto se logra incorporando el parámetro hue, que introduce la segunda variable categórica asignando un color distinto a cada una de sus categorías:

plt.figure(figsize = (8, 5))

sns.countplot(y = 'class', hue = 'alive',

stat = 'percent',

order = ['First', 'Second', 'Third'],

palette = colors_v,

edgecolor = 'black',

data = data_titanic)

plt.xlabel('Porcentaje (%)', fontweight = 'bold')

plt.ylabel('Clase', fontweight = 'bold')

plt.yticks(ticks = range(3),

labels = ['Primera', 'Segunda', 'Tercera'])

plt.legend(title = 'Supervivencia', labels = ['No', 'Sí'],

facecolor = 'white')

plt.show()

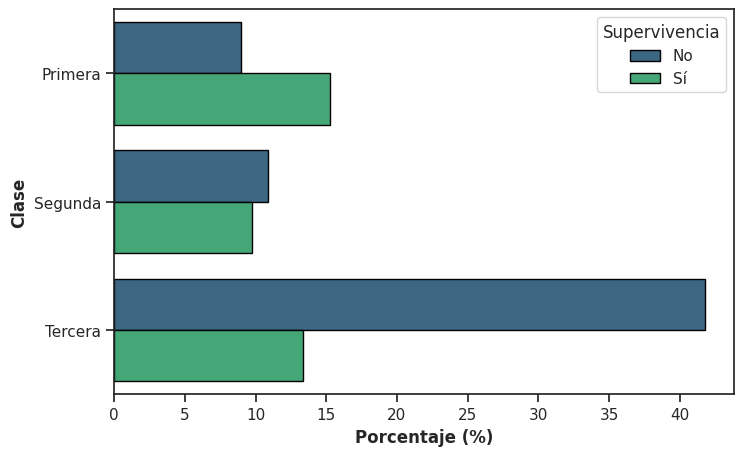

Es clave entender qué representan exactamente los porcentajes en este gráfico. Con stat = ‘percent’, countplot() calcula los porcentajes sobre el total de observaciones del dataset. Es decir, cada barra indica qué fracción del total corresponde a esa combinación particular de clase y supervivencia. En consecuencia, todas las barras del gráfico suman 100 % y el gráfico muestra lo que se conoce como la distribución conjunta de ambas variables.

Por ejemplo, puede observarse que una proporción importante del total de pasajeros corresponde a personas que viajaban en tercera clase y no sobrevivieron.

Podemos obtener esta misma información en forma tabular:

data_titanic.value_counts(['class', 'alive'], normalize = True).mul(100).round(2).sort_index(level='class')

class alive

First no 8.98

yes 15.26

Second no 10.89

yes 9.76

Third no 41.75

yes 13.36

Name: proportion, dtype: float64

Tablas de contingencia y proporciones#

Otra forma de resumir la relación entre dos variables categóricas es mediante una tabla de contingencia, que podemos construir con crosstab().

Una tabla de contingencia es una tabla de doble entrada que muestra la frecuencia conjunta de dos variables categóricas. Cada celda indica cuántas observaciones pertenecen simultáneamente a una categoría de la primera variable (filas) y a una categoría de la segunda (columnas). En este sentido, permite ver cómo se distribuyen los datos considerando ambas variables al mismo tiempo.

pd.crosstab(data_titanic['class'], data_titanic['alive'])

| alive | no | yes |

|---|---|---|

| class | ||

| First | 80 | 136 |

| Second | 97 | 87 |

| Third | 372 | 119 |

Por ejemplo, en la tabla anterior el valor 372 indica la cantidad de pasajeros que viajaban en tercera clase y no sobrevivieron al naufragio.

El argumento normalize permite transformar esta tabla en frecuencias relativas o proporciones (que luego podrán transformarse en porcentajes multiplicándolas por 100):

normalize = 'all': divide sobre el total de observaciones (distribución conjunta)normalize = 'index': divide por filas (distribución condicional por fila).normalize = 'columns': divide por columnas (distribución condicional por columna)

Por ejemplo, la distribución conjunta en escala porcentual es:

pd.crosstab(data_titanic['class'], data_titanic['alive'], normalize = 'all').mul(100).round(2)

| alive | no | yes |

|---|---|---|

| class | ||

| First | 8.98 | 15.26 |

| Second | 10.89 | 9.76 |

| Third | 41.75 | 13.36 |

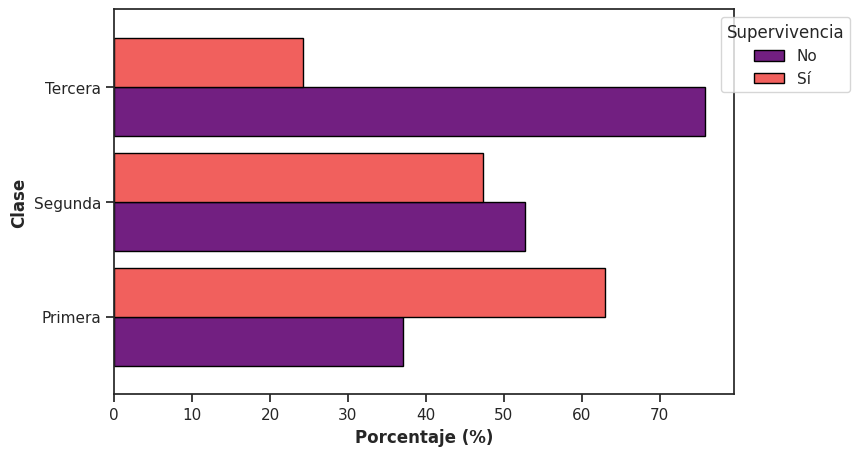

Distribución condicional#

Muchas veces, sin embargo, el interés está en responder preguntas del tipo:

¿qué proporción de pasajeros sobrevivió dentro de cada clase?

Esto requiere trabajar con la distribución condicional de la variable alive dada la clase, es decir, calcular porcentajes dentro de cada grupo:

tabla_cond = pd.crosstab(data_titanic['class'],

data_titanic['alive'],

normalize = 'index').mul(100).round(2)

tabla_cond

| alive | no | yes |

|---|---|---|

| class | ||

| First | 37.04 | 62.96 |

| Second | 52.72 | 47.28 |

| Third | 75.76 | 24.24 |

Podemos representar esta información con un gráfico de barras paralelas. En este caso utilizamos el método plot.barh() de Pandas:

tabla_cond.plot.barh(figsize = (8,5),

stacked = False,

color = colors_m,

edgecolor = 'black',

width = 0.85)

plt.xlabel('Porcentaje (%)', fontweight = 'bold')

plt.ylabel('Clase', fontweight = 'bold', )

plt.yticks(ticks = range(3), labels = ['Primera', 'Segunda', 'Tercera'])

plt.legend(title = 'Supervivencia', labels = ['No', 'Sí'],

facecolor = 'white', bbox_to_anchor = (1.2,1))

plt.show()

Este gráfico permite comparar directamente proporciones dentro de cada clase. Por ejemplo, se observa que la proporción de personas que no sobrevivieron es considerablemente mayor en tercera clase que en primera.

A diferencia de lo que ocurría antes, aquí no utilizamos countplot(). Esto se debe a que countplot() calcula automáticamente los conteos o porcentajes sobre el total del dataset, por lo que representa distribuciones conjuntas. En este caso, en cambio, ya realizamos un cálculo previo para obtener porcentajes dentro de cada clase (distribución condicional). Por lo tanto, necesitamos un gráfico que simplemente represente esos valores ya calculados, sin volver a procesarlos. Para ello utilizamos directamente los métodos de graficación de Pandas.

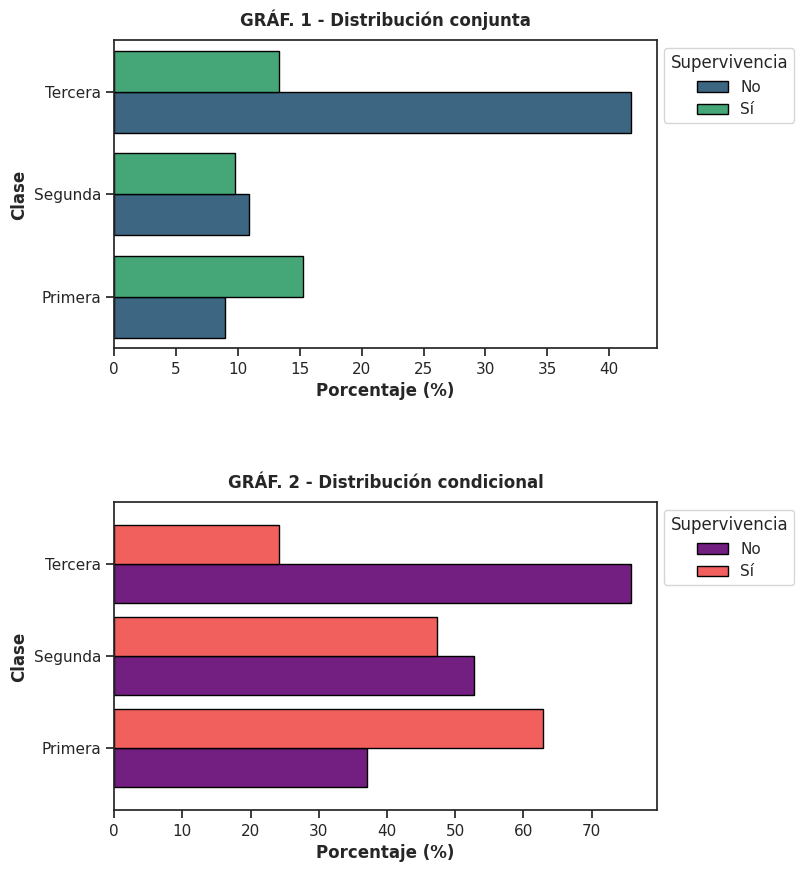

Comparación: distribución conjunta vs. condicional#

Comparemos ahora ambas representaciones:

El primer gráfico muestra la distribución conjunta: los porcentajes se calculan sobre el total de pasajeros, por lo que todas las barras suman 100 %.

El segundo gráfico muestra la distribución condicional: los porcentajes se calculan dentro de cada clase, por lo que cada fila suma 100 %.

Esta diferencia es fundamental: el primer gráfico describe la composición del total, mientras que el segundo permite comparar proporciones entre grupos.

¿Distribución conjunta o condicional?

Al interpretar un gráfico de barras agrupadas conviene preguntarse siempre sobre qué base se calcularon los porcentajes. La respuesta cambia completamente el mensaje del gráfico: visualizar la distribución conjunta muestra el peso de cada combinación dentro del total; visualizar distribuciones condicionales permite comparar el comportamiento de una variable dentro de cada categoría de la otra.

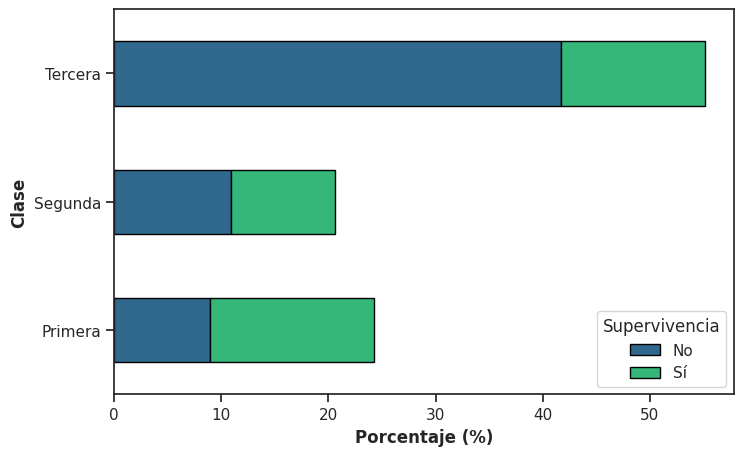

Barras apiladas#

Una alternativa para representar estas relaciones son los gráficos de barras apiladas, que permiten visualizar simultáneamente el total y su composición interna.

Distribución conjunta#

Partimos de la tabla de proporciones sobre el total:

tabla_porc = pd.crosstab(data_titanic['class'],

data_titanic['alive'],

normalize = 'all').mul(100).round(2)

tabla_porc

| alive | no | yes |

|---|---|---|

| class | ||

| First | 8.98 | 15.26 |

| Second | 10.89 | 9.76 |

| Third | 41.75 | 13.36 |

Y construimos el gráfico:

tabla_porc.plot.barh(figsize = (8, 5),

stacked = True,

color = colors_v,

edgecolor = 'black')

plt.xlabel('Porcentaje (%)', fontweight = 'bold')

plt.ylabel('Clase', fontweight = 'bold')

plt.yticks(ticks = range(3), labels = ['Primera', 'Segunda', 'Tercera'])

legend = plt.legend(title = 'Supervivencia', labels = ['No', 'Sí'], facecolor = 'white')

plt.show()

Aquí la longitud total de cada barra representa el porcentaje de pasajeros en esa clase y cada segmento muestra cómo se distribuye ese grupo según la supervivencia al naufragio del barco.

Distribución condicional#

Si en cambio usamos la tabla condicional:

tabla_cond.plot.barh(figsize = (8, 5),

stacked = True,

color = colors_m,

edgecolor = 'black')

plt.xlabel('Porcentaje (%)', fontweight = 'bold')

plt.ylabel('Clase', fontweight = 'bold')

plt.yticks(ticks = range(3), labels = ['Primera', 'Segunda', 'Tercera'])

legend = plt.legend(title = 'Supervivencia', labels = ['No', 'Sí'], facecolor = 'white', bbox_to_anchor = (1,1))

plt.show()

En este caso todas las barras tienen la misma longitud (100 %) y lo que varía es la proporción interna de cada categoría.

Este tipo de gráfico resalta aún más la comparación entre grupos, ya que elimina el efecto del tamaño de cada categoría y permite enfocarse únicamente en las diferencias relativas.

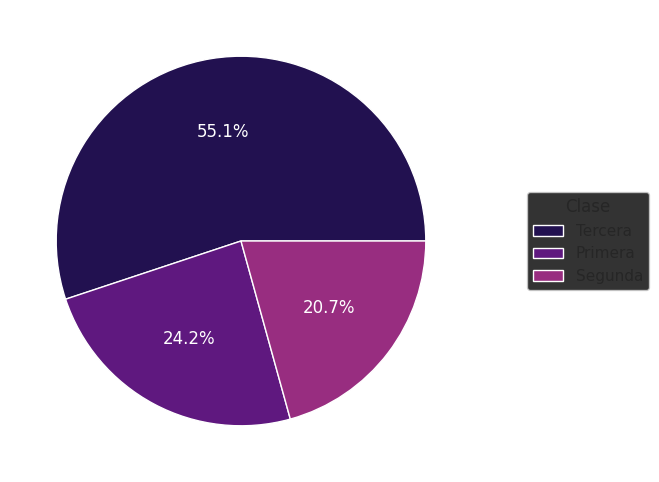

Gráfico de sectores#

El gráfico de sectores (o pie chart) representa la distribución de una variable categórica como un círculo que equivale al 100 % de las observaciones. Cada categoría se muestra como un sector del círculo, cuyo tamaño es proporcional a la frecuencia o porcentaje de observaciones en esa categoría.

A diferencia del gráfico de barras, donde comparamos longitudes, en este caso la comparación se realiza a partir de áreas.

Para construir un gráfico de sectores para la variable class, primero generamos una tabla con los porcentajes correspondientes a cada categoría:

tabla_clases = data_titanic['class'].value_counts(normalize = True).mul(100).round(1).reset_index().rename(columns = {'class': 'Clase', 'proportion': 'Porcentaje'})

tabla_clases

| Clase | Porcentaje | |

|---|---|---|

| 0 | Third | 55.1 |

| 1 | First | 24.2 |

| 2 | Second | 20.7 |

Luego, utilizamos la función pie() de matplotlib para representar estos valores:

plt.figure(figsize = (6, 6))

color = sns.color_palette('magma')

plt.pie(data = tabla_clases,

labels = 'Clase',

x = 'Porcentaje',

colors = color,

autopct = '%.1f%%',

textprops = dict(color = "w"))

plt.legend(title = 'Clase',

labels = ['Tercera', 'Primera', 'Segunda'],

loc = 'center right',

bbox_to_anchor=(1.4, 0.5))

plt.show()

El gráfico permite visualizar cómo se distribuyen las observaciones entre las distintas categorías. En este caso, se observa que la mayor proporción de pasajeros viajaba en tercera clase, ya que el área del sector correspondiente a la misma es la mayor de las tres.

Si bien es un gráfico muy difundido, el gráfico de sectores presenta algunas limitaciones importantes:

La comparación entre categorías es menos precisa, ya que el ojo humano compara peor áreas que longitudes.

Diferencias pequeñas entre proporciones pueden ser difíciles de percibir.

Se vuelve poco claro cuando hay muchas categorías.

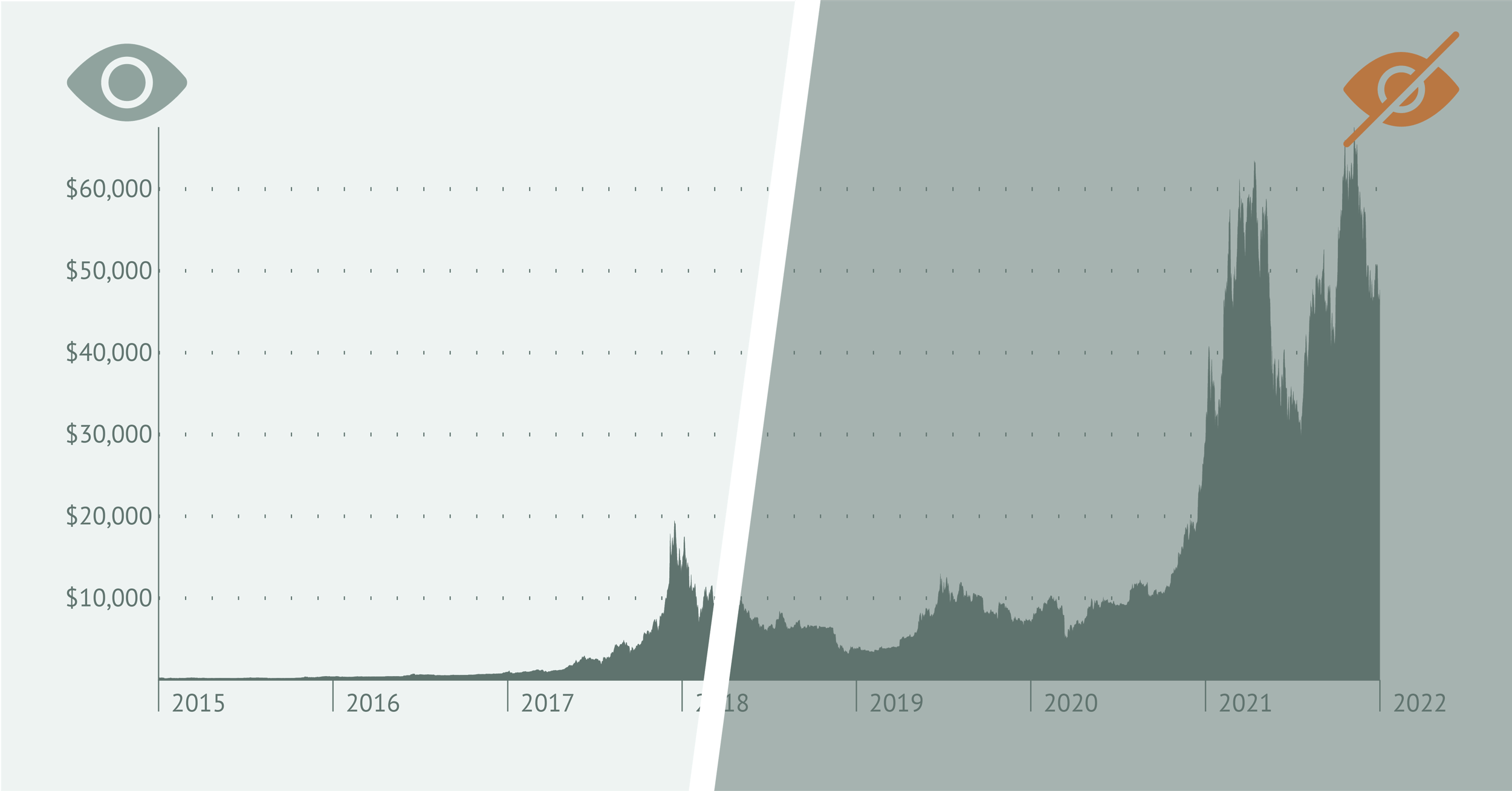

Visualizar series de tiempo#

Una serie temporal es una secuencia de observaciones de una variable registradas en puntos específicos en el tiempo. A diferencia de otros tipos de datos, las observaciones que componen una serie temporal no son independientes entre sí: están ordenadas cronológicamente, y cada valor tiene un “antes” y un “después”. Esta estructura impone una lógica particular sobre cómo debemos visualizar los datos.

Cuando graficamos una serie temporal, el eje horizontal representa el tiempo y los puntos se distribuyen de izquierda a derecha siguiendo ese orden natural. Esto significa que cada observación tiene exactamente un vecino anterior y uno posterior (salvo los extremos de la serie), lo que nos habilita a conectar los puntos mediante líneas. El resultado es lo que se conoce como un gráfico de líneas.

Vale la pena detenerse un momento en qué representan esas líneas. Estrictamente hablando, no corresponden a datos observados: son interpolaciones visuales entre mediciones reales. Si las observaciones estuvieran más espaciadas en el tiempo, los valores intermedios probablemente no caerían sobre la línea trazada. Sin embargo, los gráficos de líneas son una convención ampliamente aceptada en la visualización de series temporales porque cumplen una función muy clara: hacen visible la evolución de la variable a lo largo del tiempo y facilitan la detección de tendencias y comportamientos estacionales. Cuando sea pertinente, es buena práctica aclararlo en el epígrafe del gráfico, con una frase del tipo “las líneas son una guía visual”.

Un ejemplo: el acceso a Internet en Argentina#

Para ilustrar estas ideas, trabajaremos con datos del Banco Mundial sobre el porcentaje de personas con acceso a Internet a lo largo del tiempo en distintos países (puede descargarse acá). El primer paso es importar ese dataset al entorno de trabajo y realizar algunas tareas de limpieza y filtrado que nos permitirán obtener el conjunto de datos listo para analizar.

# Importamos el dataset

data_internet = pd.read_csv('datasets/data_internet.csv', skiprows = 4)

# Filtramos sólo algunos países

lista_paises = ['Iceland', 'Norway', 'United Kingdom', 'Japan', 'Canada', 'Germany', 'New Zealand',

'France', 'Israel', 'Argentina', 'United States', 'Chile', 'Italy', 'Brazil', 'Mexico',

'South Africa', 'China', 'Algeria', 'India', 'Kenia']

data_internet_f = data_internet[(data_internet['Country Name'].isin(lista_paises))]

# Eliminamos columnas innecesarias

data_internet_f = data_internet_f.drop(['Country Code', 'Indicator Name', 'Indicator Code', 'Unnamed: 70'], axis = 1)

# Filtramos los últimos 30 años (datos para todos los países que seleccionamos)

data_internet_f = data_internet_f[

['Country Name'] + [col for col in data_internet_f.columns if col.isdigit() and 1994 <= int(col) <= 2024]

]

# Seteamos Country Name como index

data_internet_f.set_index('Country Name', inplace = True)

# Visualizamos las primeras filas

data_internet_f.head(3)

| 1994 | 1995 | 1996 | 1997 | 1998 | 1999 | 2000 | 2001 | 2002 | 2003 | ... | 2015 | 2016 | 2017 | 2018 | 2019 | 2020 | 2021 | 2022 | 2023 | 2024 | |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Country Name | |||||||||||||||||||||

| Argentina | 0.0437 | 0.0863 | 0.142 | 0.280 | 0.831 | 3.28 | 7.038683 | 9.780807 | 10.882124 | 11.913697 | ... | 68.043064 | 70.968981 | 74.294907 | 77.700000 | 79.946952 | 85.514386 | 87.150707 | 88.375357 | 89.228972 | 89.667152 |

| Brazil | 0.0377 | 0.1050 | 0.451 | 0.786 | 1.480 | 2.04 | 2.870685 | 4.528495 | 9.149425 | 13.207586 | ... | 58.327952 | 60.872540 | 67.471285 | 70.434283 | 73.912440 | 81.342694 | 80.689893 | 80.527751 | 84.150602 | 84.463472 |

| Canada | 2.3800 | 4.1600 | 6.760 | 15.100 | 24.900 | 36.20 | 51.300000 | 60.200000 | 61.593299 | 64.200000 | ... | 90.000000 | 91.160004 | 92.701401 | 94.640000 | 91.912903 | 92.300000 | 93.937103 | 94.000000 | 94.145302 | 94.353302 |

3 rows × 31 columns

Como primer caso, visualizamos la evolución de este indicador en Argentina entre 1994 y 2024. Para ello, necesitamos filtrar esa información y darle forma de DataFrame.

data_argentina = data_internet_f.loc['Argentina'].reset_index().rename(columns = {'index' : 'anio', 'Argentina' : 'porcentaje'})

data_argentina.head()

| anio | porcentaje | |

|---|---|---|

| 0 | 1994 | 0.0437 |

| 1 | 1995 | 0.0863 |

| 2 | 1996 | 0.1420 |

| 3 | 1997 | 0.2800 |

| 4 | 1998 | 0.8310 |

Además, teniendo en cuenta que la columna anio es de tipo object, la transformamos en int64 para poder realizar luego algunas modificaciones de escala en el gráfico:

data_argentina['anio'] = pd.to_numeric(data_argentina['anio'])

data_argentina.info()

<class 'pandas.DataFrame'>

RangeIndex: 31 entries, 0 to 30

Data columns (total 2 columns):

# Column Non-Null Count Dtype

--- ------ -------------- -----

0 anio 31 non-null int64

1 porcentaje 31 non-null float64

dtypes: float64(1), int64(1)

memory usage: 628.0 bytes

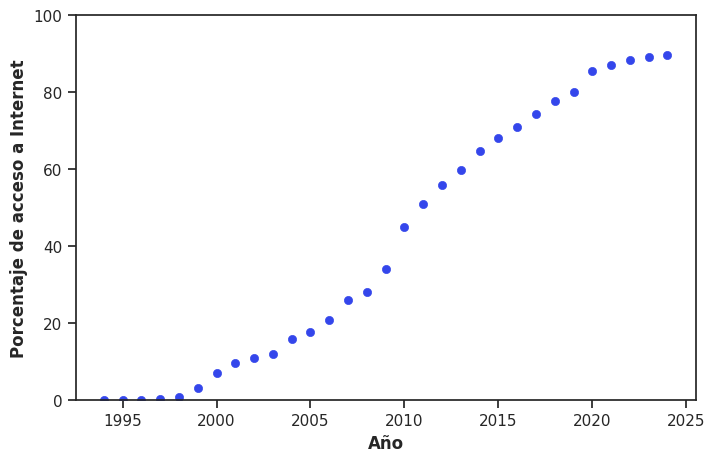

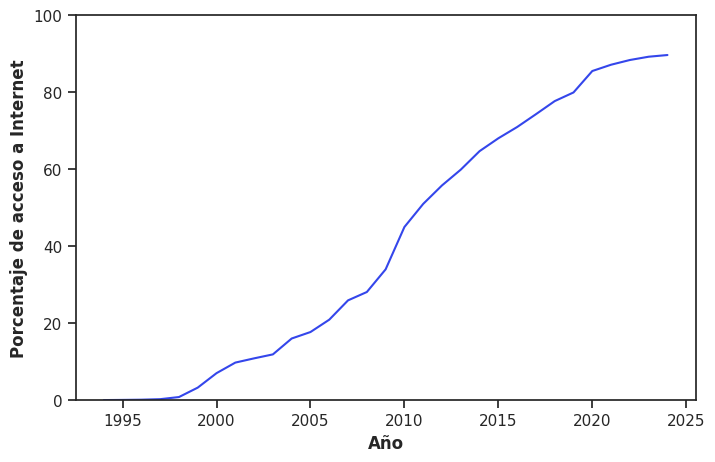

El punto de partida es un gráfico de dispersión o scatterplot donde cada punto representa el porcentaje de acceso a Internet en un año particular. Sin embargo, a diferencia de un scatterplot convencional, aquí los puntos están ordenados a lo largo del eje horizontal según el tiempo, y esa estructura es precisamente la que vamos a aprovechar.

plt.figure(figsize = (8,5))

sns.scatterplot(x = 'anio', y = 'porcentaje', s = 35, color = '#3446eb', edgecolor = '#3446eb', data = data_argentina)

plt.xlabel('Año', fontweight = 'bold')

plt.ylabel('Porcentaje de acceso a Internet', fontweight = 'bold')

plt.ylim(0, 100)

plt.show()

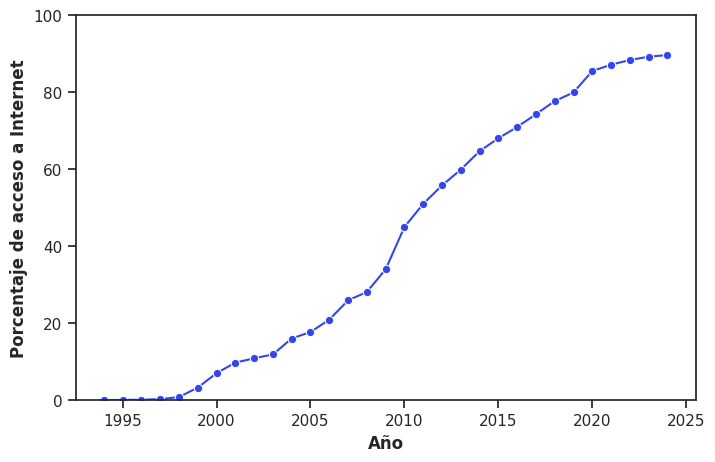

Al conectar los puntos con una línea, obtenemos un gráfico de líneas básico que ya deja ver la tendencia de crecimiento sostenido del acceso a Internet en el país. Si queremos mostrar también las observaciones individuales, podemos agregar marcadores:

plt.figure(figsize = (8,5))

sns.lineplot(x = 'anio', y = 'porcentaje', color = '#3446eb', marker = 'o', data = data_argentina)

plt.xlabel('Año', fontweight = 'bold')

plt.ylabel('Porcentaje de acceso a Internet', fontweight = 'bold')

plt.ylim(0, 100)

plt.show()

La elección de mostrar o no los puntos individuales depende del objetivo del gráfico. Incluirlos enfatiza las observaciones concretas, mientras que omitirlos pone el foco en la tendencia general. Para series con pocas observaciones muy espaciadas, los marcadores ayudan a distinguir los datos reales de la interpolación visual. Para series muy densas, los marcadores se superponen y ensucian el gráfico; en esos casos, la línea sola es suficiente.

plt.figure(figsize = (8,5))

sns.lineplot(x = 'anio', y = 'porcentaje', color = '#3446eb', data = data_argentina)

plt.xlabel('Año', fontweight = 'bold')

plt.ylabel('Porcentaje de acceso a Internet', fontweight = 'bold')

plt.ylim(0, 100)

plt.show()

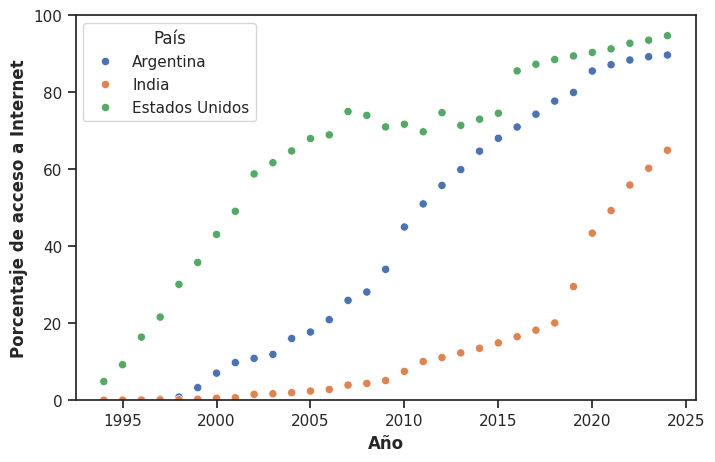

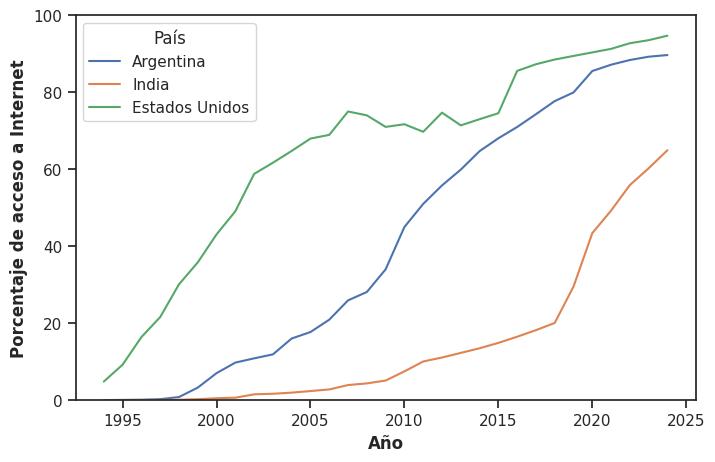

Comparar varias series temporales#

Frecuentemente nos interesa comparar la evolución de una misma variable en distintos grupos o categorías. En nuestro caso, supongamos que queremos contrastar la trayectoria del acceso a Internet en Argentina, India y Estados Unidos. Lo primero es filtrar esa información, darle forma de DataFrame en formato largo y convertir la columna anio a numérica:

data_paises = data_internet_f.loc[['Argentina', 'India', 'United States']].reset_index().melt(id_vars = 'Country Name', var_name = 'anio', value_name = 'porcentaje')

data_paises['anio'] = pd.to_numeric(data_paises['anio'])

data_paises.head(3)

| Country Name | anio | porcentaje | |

|---|---|---|---|

| 0 | Argentina | 1994 | 0.04370 |

| 1 | India | 1994 | 0.00107 |

| 2 | United States | 1994 | 4.86000 |

La forma más directa de construir esta visualización es usando el parámetro hue, que asigna un color diferente a cada categoría:

plt.figure(figsize = (8,5))

sns.scatterplot(x = 'anio', y = 'porcentaje', hue = 'Country Name', s = 35, data = data_paises)

plt.xlabel('Año', fontweight = 'bold')

plt.ylabel('Porcentaje de acceso a Internet', fontweight = 'bold')

plt.ylim(0, 100)

handles, labels = plt.gca().get_legend_handles_labels()

labels_espaniol = ['Argentina', 'India', 'Estados Unidos']

plt.legend(handles = handles, labels = labels_espaniol, title = 'País', facecolor = 'white')

plt.show()

Cuando trabajamos con múltiples series temporales, los gráficos de líneas tienen una ventaja decisiva sobre los gráficos de puntos sin conectar: las líneas ayudan al ojo a seguir cada trayectoria de forma independiente, evitando que las series se confundan entre sí:

plt.figure(figsize = (8,5))

sns.lineplot(x = 'anio', y = 'porcentaje', hue = 'Country Name', data = data_paises)

plt.xlabel('Año', fontweight = 'bold')

plt.ylabel('Porcentaje de acceso a Internet', fontweight = 'bold')

plt.ylim(0, 100)

handles, labels = plt.gca().get_legend_handles_labels()

labels_espaniol = ['Argentina', 'India', 'Estados Unidos']

plt.legend(handles = handles, labels = labels_espaniol, title = 'País', facecolor = 'white')

plt.show()

Analicemos cuál es la función que cumple el siguiente fragmento en las líneas de código anteriores

handles, labels = plt.gca().get_legend_handles_labels()

labels_espaniol = ['Argentina', 'India', 'Estados Unidos']

plt.legend(handles = handles, labels = labels_espaniol, title = 'País', facecolor = 'white')

En primer lugar, plt.gca() devuelve el objeto Axes de los ejes actuales del gráfico (“get current axes”), es decir, el “área de dibujo” donde se colocan todos los elementos visuales como líneas, barras, etiquetas, leyendas, etc.

En Matplotlib, handles son los objetos gráficos que representan los elementos que aparecen en la leyenda (por ejemplo, las líneas correspondientes a cada país). Por su parte, los labels son las etiquetas asociadas a cada uno de esos objetos. Estos dos elementos se generan automáticamente a partir del gráfico ya construido (en este caso, a partir de la variable utilizada en hue). Además, cada handle está asociado a un label en la misma posición, lo que permite modificar las etiquetas manteniendo los mismos elementos visuales.

De este modo, podemos reemplazar los labels originales por otros (por ejemplo, en español) sin necesidad de redefinir las líneas del gráfico.

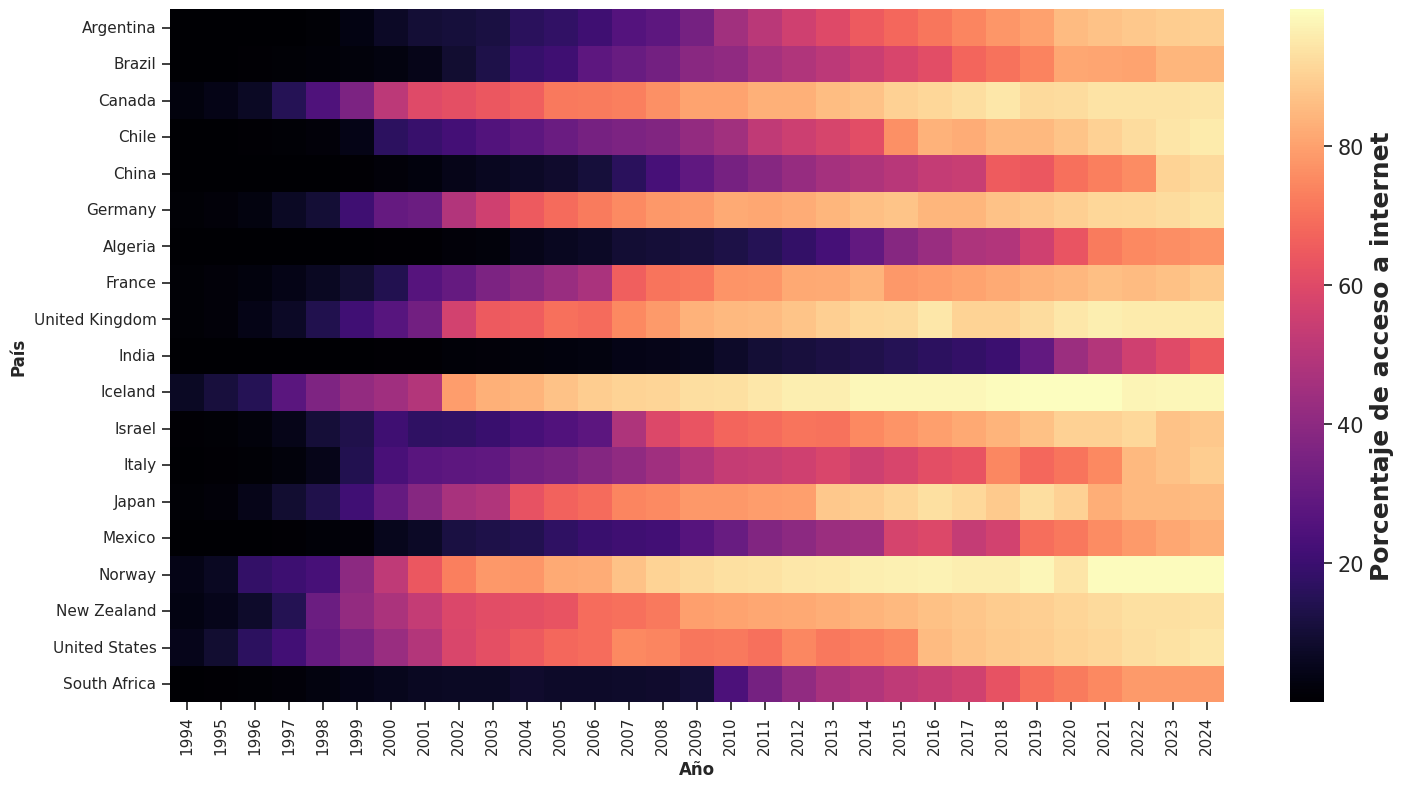

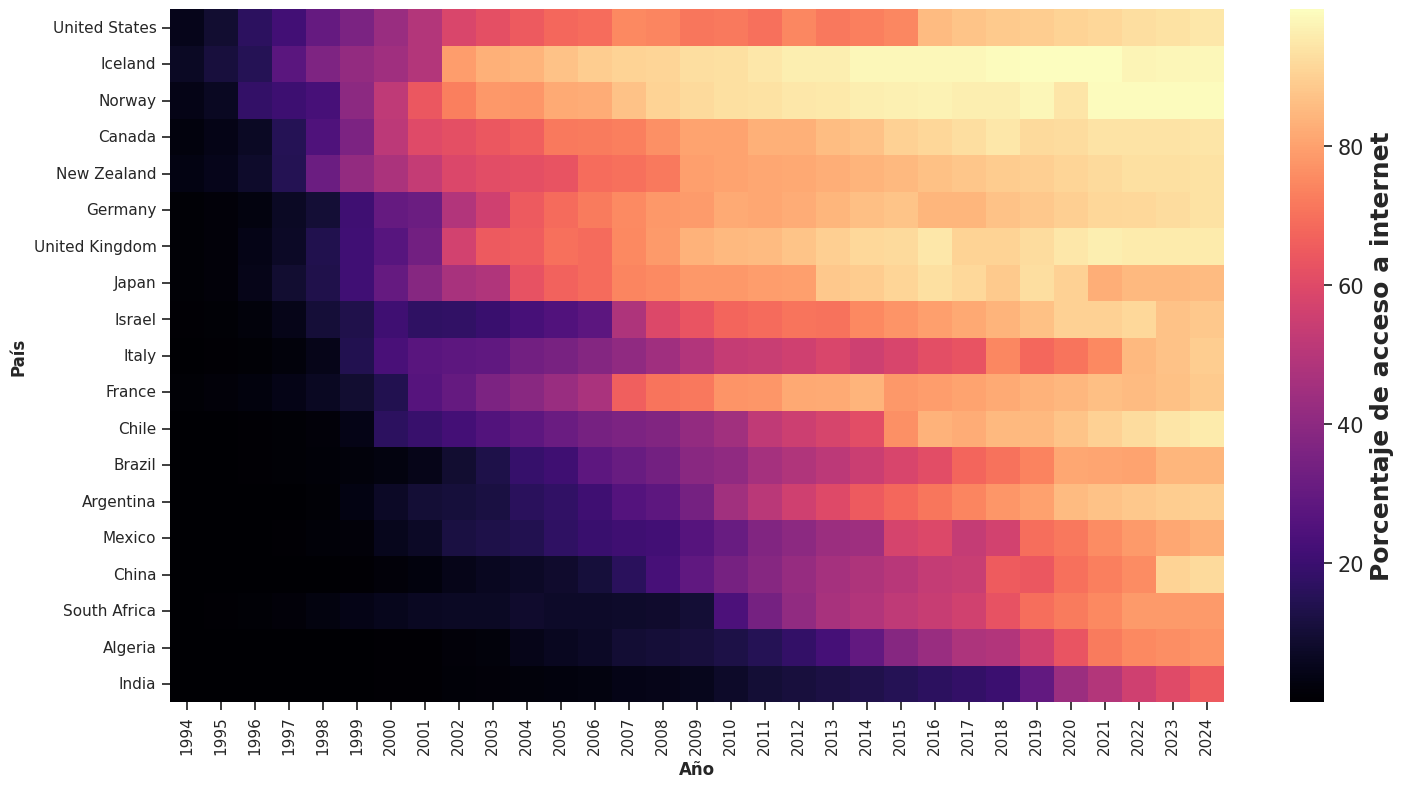

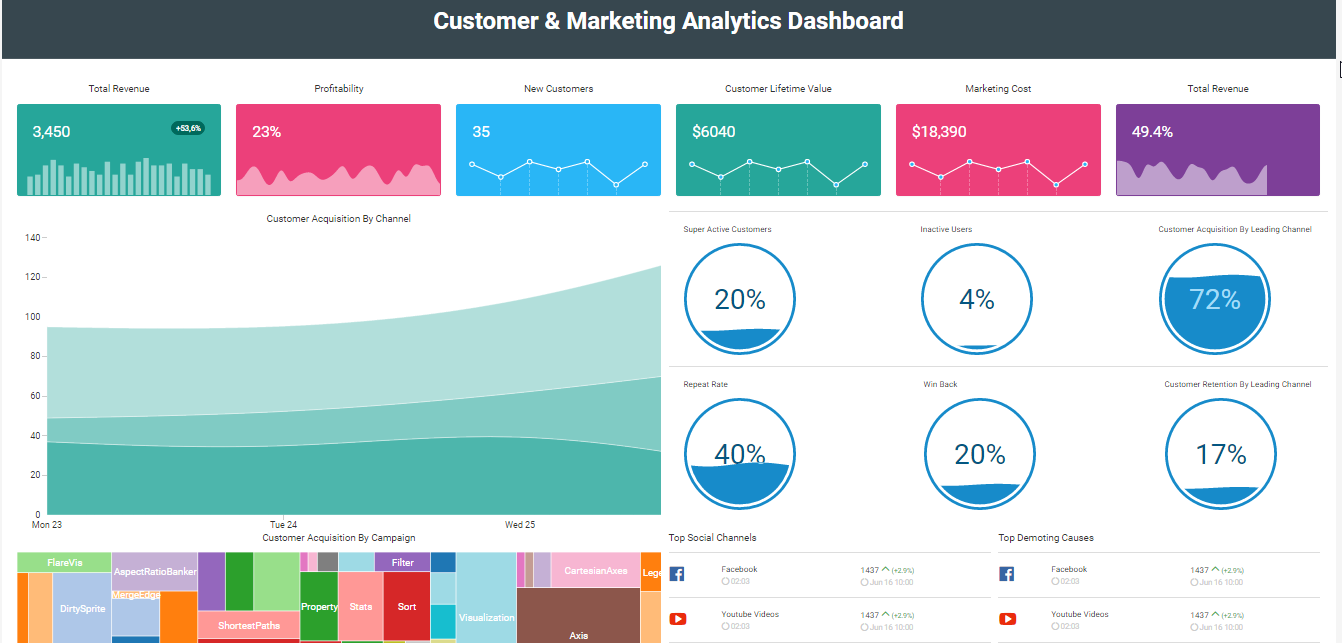

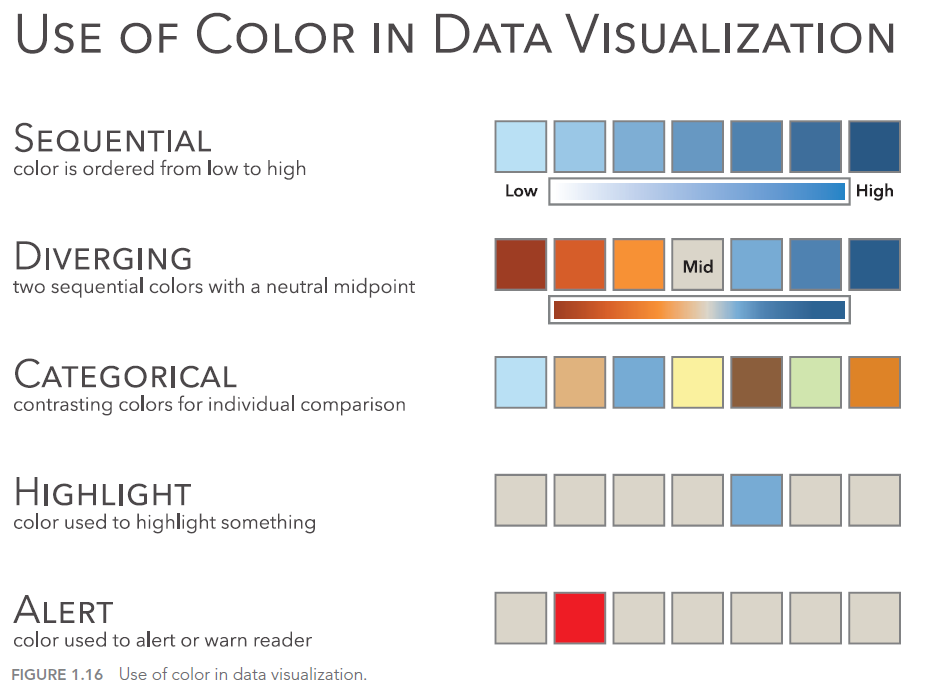

Heatmaps: cuando el color representa una cantidad#

A lo largo de las secciones anteriores hemos visto distintas formas de representar datos: gráficos para entender cómo se distribuyen los valores de una variable (segmentados o no según una variable categórica), gráficos de barras y proporciones para comparar conteos o proporciones entre categorías, y gráficos de líneas para seguir la evolución de una variable en el tiempo. Todas estas visualizaciones tienen algo en común: mapean los valores de los datos a posiciones en el espacio del gráfico, ya sea la altura de una barra, la posición de un punto o la trayectoria de una línea.

Existe, sin embargo, una alternativa: en lugar de usar la posición para representar un valor numérico, podemos usar el color. Este tipo de visualización se conoce como mapa de calor o heatmap, y resulta especialmente poderoso cuando queremos mostrar simultáneamente una variable cuantitativa en función de dos dimensiones categóricas u ordinales, por ejemplo: países y años.

El heatmap aplicado al acceso a Internet#

El gráfico de líneas que construimos en la sección anterior es ideal para comparar la evolución de dos o tres países. Pero, ¿qué ocurre si queremos visualizar los 20 países del dataset al mismo tiempo? Un gráfico de líneas con 20 series superpuestas se vuelve rápidamente ilegible: los colores se repiten, las líneas se cruzan y el ojo no logra seguir ninguna trayectoria en particular.

El heatmap ofrece una solución elegante a este problema. La idea es sencilla: construimos una grilla donde cada fila corresponde a un país y cada columna a un año, y cada celda se colorea según el valor del porcentaje de acceso a Internet en ese país y ese año. En Python, podemos construirlo con Seaborn a partir de los datos en formato ancho (que es justo el formato en el cual teníamos los datos originalmente, en el objeto data_internet_f):

plt.figure(figsize = (17,9))

ax = sns.heatmap(data_internet_f, cmap = 'magma', cbar_kws={'label': 'Porcentaje de acceso a internet'})

plt.xlabel('Año', fontweight = 'bold')

plt.ylabel('País', fontweight = 'bold')

cbar = ax.collections[0].colorbar

cbar.ax.tick_params(labelsize=15)

cbar.ax.yaxis.label.set_size(18)

cbar.ax.yaxis.label.set_fontweight('bold')

plt.show()

El resultado es una visualización compacta que permite leer patrones globales de un vistazo: qué países adoptaron Internet tempranamente, cuáles lo hicieron tarde, y cómo se distribuye el acceso Internet en los años más recientes.

Lo que el heatmap gana y lo que cede#

Como toda herramienta de visualización, el heatmap implica una serie de concesiones. Su principal fortaleza es la capacidad de mostrar muchas series simultáneamente sin saturar el gráfico: 20 países, más de 30 años, más de 600 celdas, todo en una sola figura legible. Además, permite detectar patrones estructurales con rapidez: gradientes de color que revelan tendencias, celdas aisladas que señalan anomalías, bloques de color que muestran grupos de países con comportamientos similares.

Lo que el heatmap sacrifica es la precisión en la lectura de valores individuales. Si queremos saber exactamente qué porcentaje de personas tenía acceso a Internet en Argentina en 2010, el heatmap nos dará una respuesta aproximada, no exacta. Para ese tipo de consulta, un gráfico de líneas o una tabla son herramientas más adecuadas. El heatmap no compite con ellos: los complementa.

El orden de las filas importa (y mucho)#

Una decisión de diseño que tiene un impacto enorme en lo que el heatmap comunica es el orden en que se disponen los países. No existe un único orden correcto, la elección depende de la historia que queremos contar.

Si ordenamos los países por su porcentaje de acceso a Internet en el año más reciente del dataset (año 2024), el gráfico destaca cuáles son los países con mayor acceso actual y cuáles quedaron rezagados. Esta es la pregunta más natural si nos interesa el estado del mundo hoy.

# Ordenar por acceso en el último año disponible

## Índice ordenado

orden_2024 = data_internet_f.sort_values(by = '2024', ascending = False).index

## Dataset ordenado

data_internet_ord_2024 = data_internet_f.reindex(orden_2024)

Pero si ordenamos los países por el año en que su acceso a Internet superó por primera vez un umbral determinado —digamos, el 20% de la población—, el gráfico nos cuenta una historia diferente: la de los pioneros y los tardíos en la adopción de la tecnología. Este ordenamiento puede revelar patrones sorprendentes: países que adoptaron Internet muy temprano pero que en la actualidad tienen un porcentaje relativamente bajo de su población con acceso a Internet, así como países que llegaron tarde pero crecieron de forma muy acelerada.

# Ordenar según orden de acceso del 20% de la población

## Índice ordenado

orden_20 = (data_internet_f >=20).idxmax(axis = 'columns').sort_values().index

## Dataset ordenado

data_internet_ord_20 = data_internet_f.reindex(orden_20)

Ambas representaciones son igualmente válidas. La pregunta que debemos hacernos antes de construir el gráfico no es cuál es el orden “correcto”, sino cuál es la pregunta que queremos responder. El orden de las filas no es un detalle técnico: es una decisión narrativa.

Veamos cómo luce el heatmap construido con las categorías ordenadas según este último criterio:

plt.figure(figsize = (17,9))

ax = sns.heatmap(data_internet_ord_20, cmap = 'magma', cbar_kws={'label': 'Porcentaje de acceso a internet'})

plt.xlabel('Año', fontweight = 'bold')

plt.ylabel('País', fontweight = 'bold')

cbar = ax.collections[0].colorbar

cbar.ax.tick_params(labelsize=15)

cbar.ax.yaxis.label.set_size(18)

cbar.ax.yaxis.label.set_fontweight('bold')

plt.show()

Gráficos para visualizar asociaciones entre variables cuantitativas#

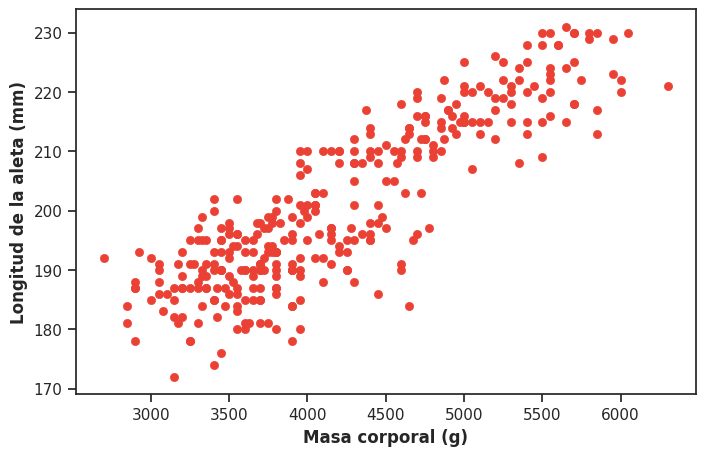

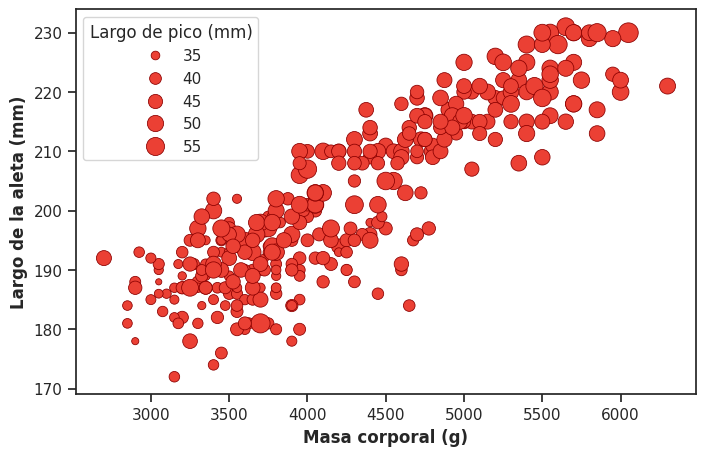

Cuando trabajamos con datasets que contienen múltiples variables cuantitativas, una pregunta natural es si existe alguna relación entre ellas. Retomando el ejemplo del dataset Penguins, podríamos preguntarnos, por ejemplo si los pingüinos más pesados tienden a tener aletas más largas y, de ser así, qué tipo de forma caracteriza a dicha relación. Para responder este tipo de preguntas necesitamos herramientas que permitan visualizar asociaciones, es decir, si dos variables cuantitativas varían o no en forma conjunta.

El scatterplot como punto de partida#

Ya vimos en detalle en la unidad anterior que el gráfico de dispersión o scatterplot es la herramienta fundamental para explorar la relación entre dos variables cuantitativas. Cada punto representa una observación, y su posición en el plano está determinada por los valores de las dos variables que estamos representando. Vale la pena recordar, a modo de repaso, el gráfico que construimos con el dataset de pingüinos del archipiélago Palmer para visualizar la relación existente entre la masa corporal y la longitud del pico:

plt.figure(figsize = (8,5))

sns.scatterplot(x = 'body_mass_g', y = 'flipper_length_mm', s = 35, color = '#eb4034', edgecolor = '#eb4034', data = data_penguins)

plt.xlabel('Masa corporal (g)', fontweight = 'bold')

plt.ylabel('Longitud de la aleta (mm)', fontweight = 'bold')

plt.show()

La nube de puntos resultante muestra con claridad que la relación entre ambas variables es lineal, intensa y que los pingüinos más pesados tienden a tener aletas más largas (dirección positiva). También vimos que podemos incorporar una variable categórica codificándola mediante el color de los puntos, lo que permite distinguir si un patrón se mantiene en todos los grupos o si es distinto entre ellos.

Lo que nos preguntamos ahora es: ¿qué hacemos cuando queremos explorar no una sino varias relaciones al mismo tiempo?

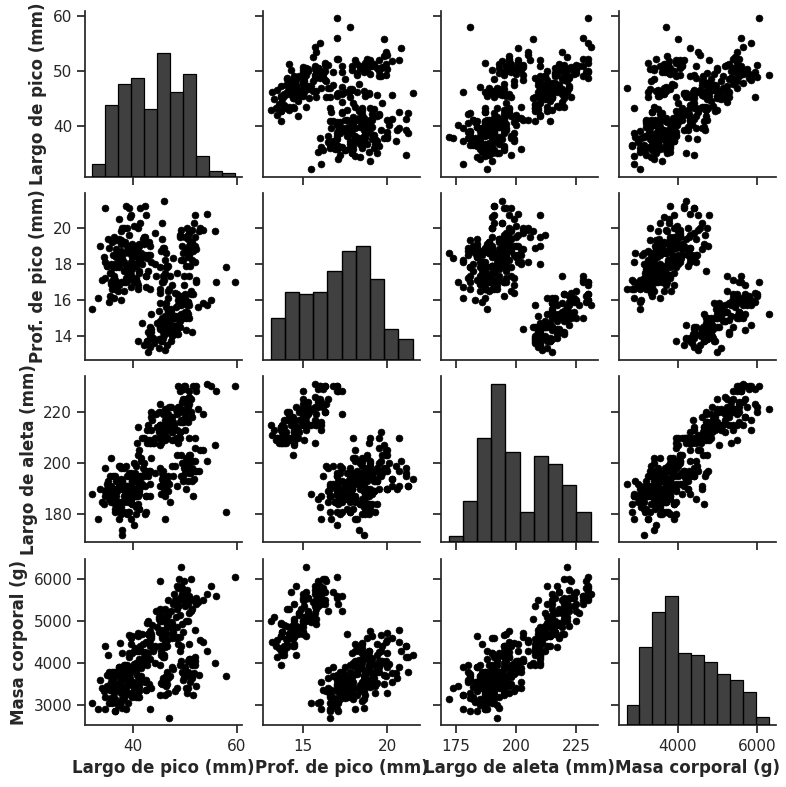

Matrices de scatterplots#

El dataset de pingüinos incluye cuatro variables cuantitativas: longitud del pico (bill_length_mm), profundidad del pico (bill_depth_mm), longitud de la aleta (flipper_length_mm) y masa corporal (body_mass_g). Si quisiéramos estudiar la relación entre cada par posible de estas variables, tendríamos que construir seis scatterplots por separado. La función pairplot() de Seaborn resuelve este problema de forma elegante, generando automáticamente la matriz de scatterplots para todas las combinaciones posibles:

# Diccionario para renombrar columnas

nombres_ejes = {'bill_length_mm': 'Largo de pico (mm)', 'bill_depth_mm': 'Prof. de pico (mm)',

'flipper_length_mm' : 'Largo de aleta (mm)', 'body_mass_g' : 'Masa corporal (g)'}

# DataFrame con columnas renombradas (sólo para plotear)

data_plot = data_penguins.rename(columns = nombres_ejes)

# Construimos la matriz de gráficos

g = sns.pairplot(

vars = list(nombres_ejes.values()),

data = data_plot,

height = 2,

plot_kws = {'color': 'black', 'edgecolor': 'black', 's': 25},

diag_kws = {'color': 'black', 'edgecolor': 'black'}

)

# Para que todos los títulos de ejes estén en negrita

for ax in g.axes.flatten():

ax.xaxis.label.set_fontweight('bold')

ax.yaxis.label.set_fontweight('bold')

plt.show()

El resultado es una grilla donde cada celda fuera de la diagonal muestra el scatterplot entre un par de variables, y cada celda en la diagonal muestra la distribución individual de cada variable mediante un histograma. La matriz es simétrica: el gráfico en la posición (\(i\), \(j\)) muestra las mismas variables que el de la posición (\(j\), \(i\)), pero con los ejes intercambiados.

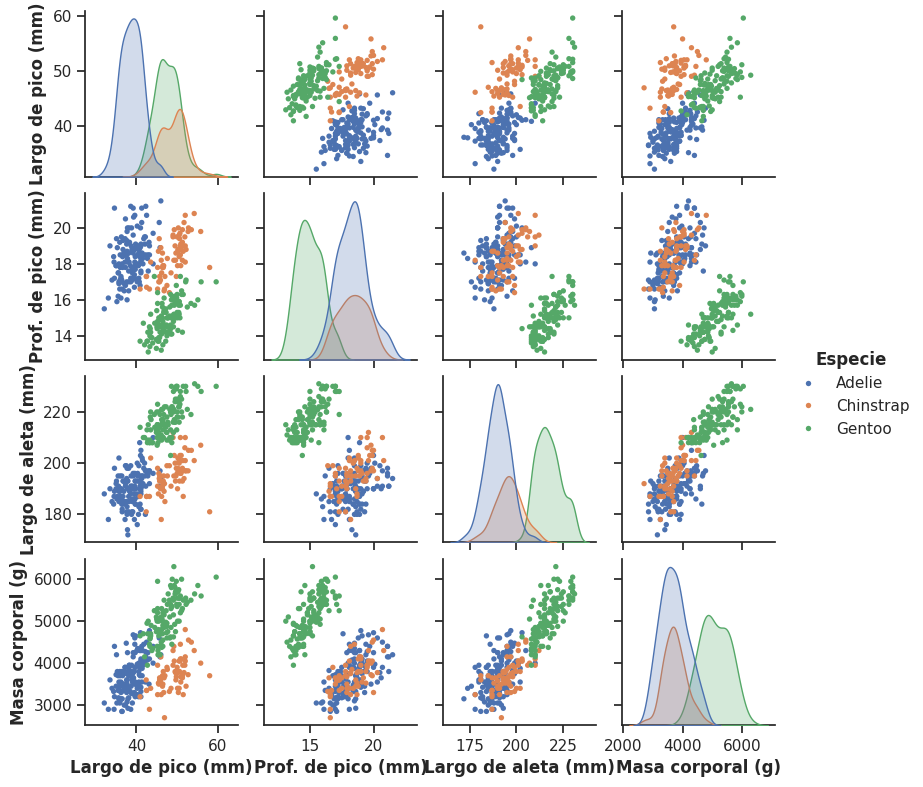

Como ya hicimos con el scatterplot simple, podemos incorporar la variable species mediante el parámetro hue para visualizar si los patrones de asociación difieren entre las tres especies:

# Renombramos columna 'species' para cambiar fácil el título de la leyenda

data_plot.rename(columns = {'species' : 'Especie'}, inplace = True)

# Construimos la matriz de gráficos, mapeando la especie al color

g = sns.pairplot(

vars = list(nombres_ejes.values()),

hue = 'Especie',

data = data_plot,

height = 2,

plot_kws = {'edgecolor': 'none', 's': 15}

)

# Para que todos los títulos de ejes y el de la leyenda estén en negrita

for ax in g.axes.flatten():

ax.xaxis.label.set_fontweight('bold')

ax.yaxis.label.set_fontweight('bold')

g._legend.get_title().set_fontweight('bold')

plt.show()

Cuando se usa hue, la diagonal deja de mostrar histogramas y pasa a mostrar curvas de densidad superpuestas para cada especie. Esto permite comparar tanto las asociaciones entre los distintos pares de variables como la distribución de cada una de estas variables entre las categorías de la variable cualitativa mapeada al color.

La matriz de scatterplots es una herramienta poderosa porque explota lo que mejor hacemos los seres humanos al leer gráficos: juzgar posiciones. Cada relación se representa en su propio panel, sin que las variables compitan entre sí por el espacio visual.

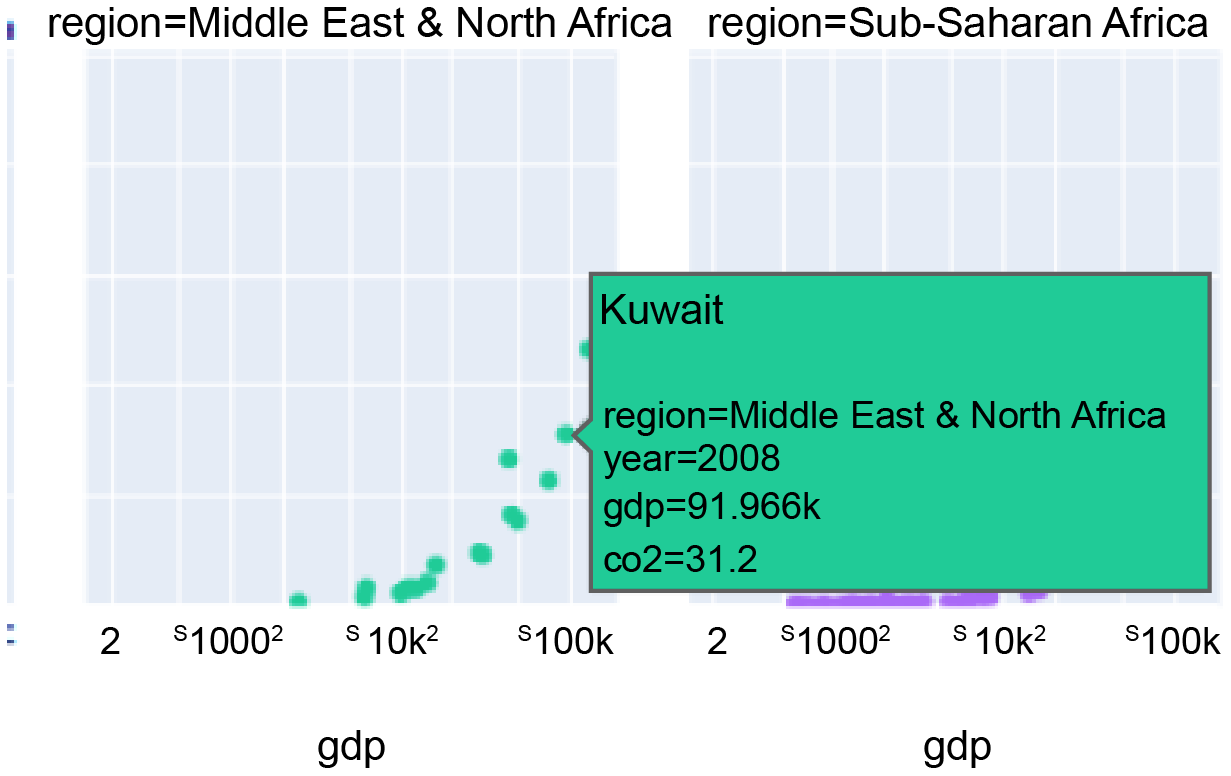

Bubble charts: una tercera variable cuantitativa en el tamaño#

Una alternativa que a veces se propone para incorporar una tercera variable cuantitativa en un scatterplot es codificarla en el tamaño de los puntos. Este tipo de gráfico se conoce como bubble chart y en Seaborn se construye mapeando esa variable cuantitativa adicional en el parámetro size dentro de sns.scatterplot():

plt.figure(figsize = (8,5))

sns.scatterplot(x = 'body_mass_g', y = 'flipper_length_mm',

size = 'bill_length_mm', sizes = (20, 200),

color = '#eb4034', edgecolor = 'darkred',

data = data_penguins)

plt.xlabel('Masa corporal (g)', fontweight = 'bold')

plt.ylabel('Largo de la aleta (mm)', fontweight = 'bold')

plt.legend(title = 'Largo de pico (mm)', facecolor = 'white')

plt.show()

El resultado puede parecer atractivo, pero en la práctica presenta limitaciones importantes que vale la pena conocer.

En primer lugar, los seres humanos somos significativamente menos precisos para juzgar diferencias de tamaño o área que para juzgar diferencias de posición. Eso significa que las asociaciones que involucran la tercera variable —la que se codifica en el tamaño de los puntos— son mucho más difíciles de percibir que las que se leen en los ejes.

En segundo lugar, los rangos de tamaño disponibles son necesariamente pequeños en relación al tamaño total de la figura, lo que hace que diferencias moderadas en los datos se traduzcan en cambios casi imperceptibles en el tamaño de los puntos.

En tercer lugar, el gráfico mezcla dos tipos de escalas visuales —posición y área— que no se perciben con la misma facilidad ni con la misma precisión.

Por estas razones, cuando el objetivo es entender las relaciones entre tres o más variables cuantitativas, suele ser preferible recurrir a múltiples visualizaciones más simples —como la matriz de scatterplots— antes que intentar condensar todo en un único gráfico complejo. El principio general es claro: la posición es el canal visual más preciso y debería ser el primero en aprovecharse.

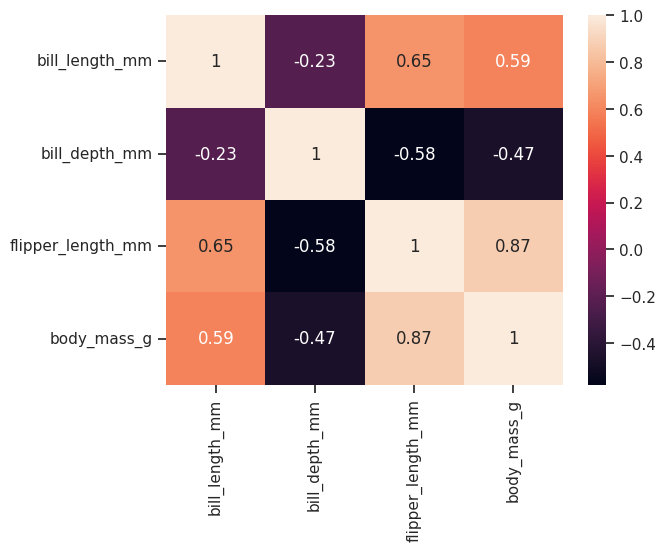

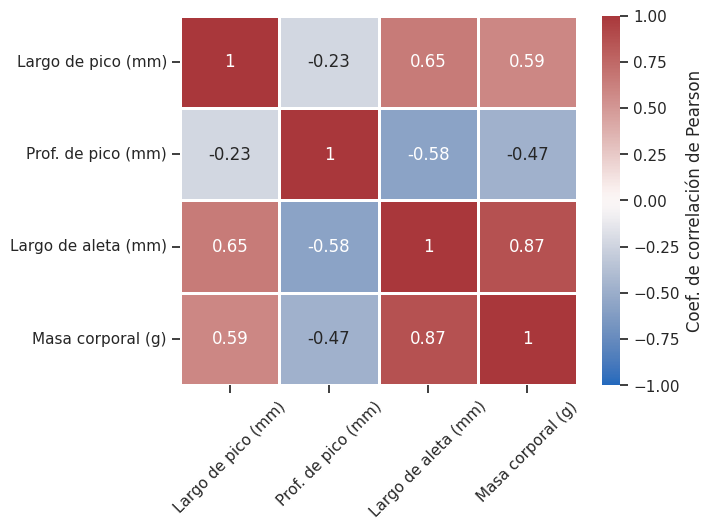

Correlogramas#

En la unidad anterior presentamos el coeficiente de correlación lineal de Pearson (\(r\)) como una herramienta para cuantificar el grado de asociación lineal entre dos variables de naturaleza cuantitativa. Vimos que toma valores entre -1 y 1. Un valor cercano a 1 indica una asociación lineal positiva fuerte: cuando una variable aumenta, la otra tiende a aumentar también. Un valor cercano a -1 indica una asociación lineal negativa fuerte: cuando una variable aumenta, la otra tiende a disminuir. Un valor cercano a 0 indica que no hay asociación lineal entre las variables. La fórmula que lo define es:

Una propiedad importante de \(r\) (que ya mencionamos con anterioridad) es que es simétrico: la correlación de \(x\) con \(y\) es idéntica a la de \(y\) con \(x\). Otra propiedad relevante es que es invariante ante cambios de escala y de origen: si multiplicamos o sumamos una constante a todos los valores de una variable, el coeficiente de correlación no cambia.

La matriz de correlación reúne todos los coeficientes \(r\) entre pares de variables en una tabla cuadrada. Para visualizarla, podemos construir un correlograma: un heatmap donde cada celda representa la correlación entre dos variables y se colorea según su valor.